Scrapy是一个为了爬取网站数据,提取结构性数据而编写的应用框架。 其可以应用在数据挖掘,信息处理或存储历史数据等一系列的程序中。

其最初是为了页面抓取 (更确切来说, 网络抓取 )所设计的, 也可以应用在获取API所返回的数据(例如 Amazon Associates Web Services ) 或者通用的网络爬虫。Scrapy用途广泛,可以用于数据挖掘、监测和自动化测试。

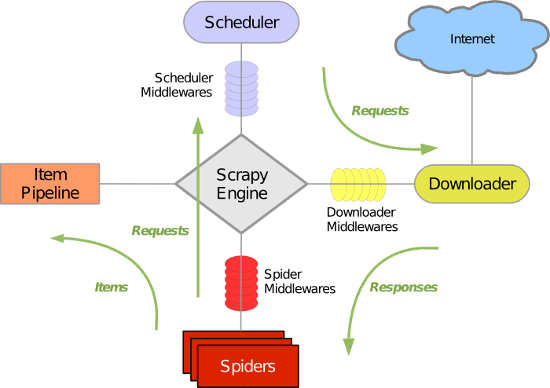

Scrapy 使用了 Twisted异步网络库来处理网络通讯。整体架构大致如下

Scrapy主要包括了以下组件:

- 引擎(Scrapy)

用来处理整个系统的数据流处理, 触发事务(框架核心) - 调度器(Scheduler)

用来接受引擎发过来的请求, 压入队列中, 并在引擎再次请求的时候返回. 可以想像成一个URL(抓取网页的网址或者说是链接)的优先队列, 由它来决定下一个要抓取的网址是什么, 同时去除重复的网址 - 下载器(Downloader)

用于下载网页内容, 并将网页内容返回给蜘蛛(Scrapy下载器是建立在twisted这个高效的异步模型上的) - 爬虫(Spiders)

爬虫是主要干活的, 用于从特定的网页中提取自己需要的信息, 即所谓的实体(Item)。用户也可以从中提取出链接,让Scrapy继续抓取下一个页面 - 项目管道(Pipeline)

负责处理爬虫从网页中抽取的实体,主要的功能是持久化实体、验证实体的有效性、清除不需要的信息。当页面被爬虫解析后,将被发送到项目管道,并经过几个特定的次序处理数据。 - 下载器中间件(Downloader Middlewares)

位于Scrapy引擎和下载器之间的框架,主要是处理Scrapy引擎与下载器之间的请求及响应。 - 爬虫中间件(Spider Middlewares)

介于Scrapy引擎和爬虫之间的框架,主要工作是处理蜘蛛的响应输入和请求输出。 - 调度中间件(Scheduler Middewares)

介于Scrapy引擎和调度之间的中间件,从Scrapy引擎发送到调度的请求和响应。

Scrapy运行流程大概如下:

- 引擎从调度器中取出一个链接(URL)用于接下来的抓取

- 引擎把URL封装成一个请求(Request)传给下载器

- 下载器把资源下载下来,并封装成应答包(Response)

- 爬虫解析Response

- 解析出实体(Item),则交给实体管道进行进一步的处理

- 解析出的是链接(URL),则把URL交给调度器等待抓取

一、安装

1 Linux 2 pip3 install scrapy 3 4 Windows 5 a. pip3 install wheel 6 b. 下载twisted http://www.lfd.uci.edu/~gohlke/pythonlibs/#twisted 7 c. 进入下载目录,执行 pip3 install Twisted‑17.1.0‑cp35‑cp35m‑win_amd64.whl 8 d. pip3 install scrapy 9 e. 下载并安装pywin32:https://sourceforge.net/projects/pywin32/files/

二、基本使用

1.基本命令

1 1. scrapy startproject 项目名称 2 - 在当前目录中创建中创建一个项目文件(类似于Django) 3 4 1. cd 项目名称 5 -进行项目文件夹 6 7 2. scrapy genspider [-t template] <name> <domain> 8 - 创建爬虫应用 9 如: 10 scrapy gensipider -t basic oldboy oldboy.com 11 scrapy gensipider -t xmlfeed autohome autohome.com.cn 12 PS: 13 查看所有命令:scrapy gensipider -l 14 查看模板命令:scrapy gensipider -d 模板名称 15 16 3. scrapy list 17 - 展示爬虫应用列表 18 19 4. scrapy crawl 爬虫应用名称 20 - 运行单独爬虫应用

2.项目结构

文件说明:

- scrapy.cfg 项目的主配置信息。(真正爬虫相关的配置信息在settings.py文件中)

- items.py 设置数据存储模板,用于结构化数据,如:Django的Model

- pipelines 数据处理行为,如:一般结构化的数据持久化

- settings.py 配置文件,如:递归的层数、并发数,延迟下载等

- spiders 爬虫目录,如:创建文件,编写爬虫规则

注意:一般创建爬虫文件时,以网站域名命名

1 import scrapy 2 3 class XiaoHuarSpider(scrapy.spiders.Spider): 4 name = "xiaohuar" # 爬虫名称 ***** 5 allowed_domains = ["xiaohuar.com"] # 允许的域名 6 start_urls = [ 7 "http://www.xiaohuar.com/hua/", # 其实URL 8 ] 9 10 def parse(self, response): 11 # 访问起始URL并获取结果后的回调函数

1 import sys,os 2 sys.stdout=io.TextIOWrapper(sys.stdout.buffer,encoding='gb18030')

3.小试牛刀

1 # -*- coding: utf-8 -*- 2 import scrapy 3 from scrapy.selector import Selector,HtmlXPathSelector #选择器,标签查找 4 from ..items import ChoutiItem #创建item对象 5 from scrapy.http import Request #创建request对象,用于请求url 6 7 class ChoutiSpider(scrapy.Spider): 8 name = 'chouti' 9 allowed_domains = ['chouti.com'] #递归时会检测域名是否包含,不包含则不能递归 10 start_urls = ['https://dig.chouti.com/'] #运行最开始请求的url 11 12 # 开始url请求的地方 13 # def start_requests(self): 14 # cls = self.__class__ 15 # if method_is_overridden(cls, Spider, 'make_requests_from_url'): 16 # warnings.warn( 17 # "Spider.make_requests_from_url method is deprecated; it " 18 # "won't be called in future Scrapy releases. Please " 19 # "override Spider.start_requests method instead (see %s.%s)." % ( 20 # cls.__module__, cls.__name__ 21 # ), 22 # ) 23 # for url in self.start_urls: 24 # yield self.make_requests_from_url(url) 25 # else: 26 # for url in self.start_urls: 27 # yield Request(url, dont_filter=True) 28 29 has_request_set = set() #集合用于url去重 30 31 def parse(self, response): 32 # print(response.text) 33 # content = str(response.body,encoding='utf-8') 34 # print(content) 35 36 # 1.1查找对应标签并获取 37 hxs1 = Selector(response=response).xpath('//div[@id="content-list"]/div[@class="item"]') 38 for obj in hxs1: #obj是标签对象 39 title = obj.xpath('.//div[@class="news-content"]//a[@class="show-content color-chag"]/text()').extract_first().strip() 40 href = obj.xpath('.//div[@class="news-content"]//a[@class="show-content color-chag"]/@href').extract_first().strip() 41 42 #item实现格式化,pipeline实现标题和url持久化 43 # 2.1创建item对象,进行格式化 44 item_obj = ChoutiItem(title=title,href=href) 45 # 3.1将item对象传递给pipeline 46 yield item_obj 47 48 """ 49 选择器 50 // 表示子孙中 51 .// 当前对象的子孙中 52 / 儿子 53 /div 儿子中的div标签 54 /div[@id="i1"] 儿子中的div标签且id='i1' 55 56 obj.extract() #列表中的每个对象转换成字符串 =》 [] 57 obj.extract_first() #列表中的每个对象转换成字符串 =》 列表第一个元素 58 //div/text() #获取标签的文本 59 """ 60 61 # 1.2查找对应标签并获取 62 # ① 直接在页码中查找 63 # hxs2 = Selector(response=response).xpath('//div[@id="dig_lcpage"]//a/@href').extract() 64 # ② 直接查找a标签,以href中开头内容查找 65 # hxs2 = Selector(response=response).xpath('//a[starts-with(@href,"/all/hot/recent/")]/@href').extract() 66 # ③ 正则表达式查找 67 hxs2 = Selector(response=response).xpath('//a[re:test(@href,"/all/hot/recent/\d+")]/@href').extract() 68 # print(hxs2) 69 70 for url in hxs2: 71 url = 'https://dig.chouti.com%s' % url 72 key_url = self.md5(url) #加密 73 # 进行url去重 74 if key_url in self.has_request_set: 75 pass 76 else: 77 self.has_request_set.add(key_url) 78 print(url) 79 #2.2将要访问的url添加到调度器 80 yield Request(url=url,callback=self.parse) 81 """ 82 a/@href 获取属性 83 a/text() 获取文本 84 //a[starts-with(@href, "/all/hot/recent/")]/@href 以xx开始,获取属性 85 //a[re:test(@href, "/all/hot/recent/\d+")]/@href 正则 86 yield Request(url=url,callback=self.parse) 将新要访问的url添加到调度器 87 重写start_requests,指定最开始处理请求的方法 88 """ 89 90 #yield Request(url=url, callback=self.parse)中callback函数可以自定义 91 # 可以自定义callback函数,但是不能递归 92 # def show(self,response): 93 # print(response.text) 94 95 # 若想将较长的url存入数据库,不想使用索引的话,可以进行加密,将不同长度的url转换成相同长度的加密内容 96 def md5(self,url): 97 import hashlib 98 m = hashlib.md5() 99 m.update(bytes(url,encoding='utf-8')) 100 return m.hexdigest()

1 import scrapy 2 3 class ChoutiItem(scrapy.Item): 4 # define the fields for your item here like: 5 # name = scrapy.Field() 6 title = scrapy.Field() 7 href = scrapy.Field()

1 class Test002Pipeline(object): 2 def process_item(self, item, spider): 3 # print(item['title'],item['href']) 4 return item

1 # Obey robots.txt rules 2 ROBOTSTXT_OBEY = False 3 4 ITEM_PIPELINES = { 5 'test002.pipelines.Test002Pipeline': 300, 6 } 7 8 #注意:settings.py中设置DEPTH_LIMIT = 1来指定“递归”的层数。 9 DEPTH_LIMIT = 3

执行此爬虫文件,则在终端进入项目目录执行如下命令:

1 scrapy crawl chouti --nolog 2 #scrapy crawl chouti

对于上述代码重要之处在于:

- Request是一个封装用户请求的类,在回调函数中yield该对象表示继续访问

- Selector用于结构化HTML代码并提供选择器功能