推理正在成为大型语言模型(llm)关注的下一个主要领域。尽管llm拥有先进的能力,但大多数llm经常被简单的错误绊倒,显示出他们在推理方面的局限性。这些模型可能会被上下文中的不相关细节所误导,或者受到输入提示中的偏差的影响。而后一种倾向被称为谄媚,也就是说模型会更偏向与输入一致,而不管准确性如何。人们已经做出了各种努力来解决这些缺点,包括增加监督训练数据或应用强化学习方法。在最近的一项研究中,Meta AI认为问题的根源在于这些模型中使用的transformer 架构的基本设计,特别是注意力机制。这项研究的灵感来自丹尼尔·卡尼曼和阿莫斯·特沃斯基对行为心理学的研究,这些研究在《Thinking Fast and Slow》一书中得到了精彩的阐述。

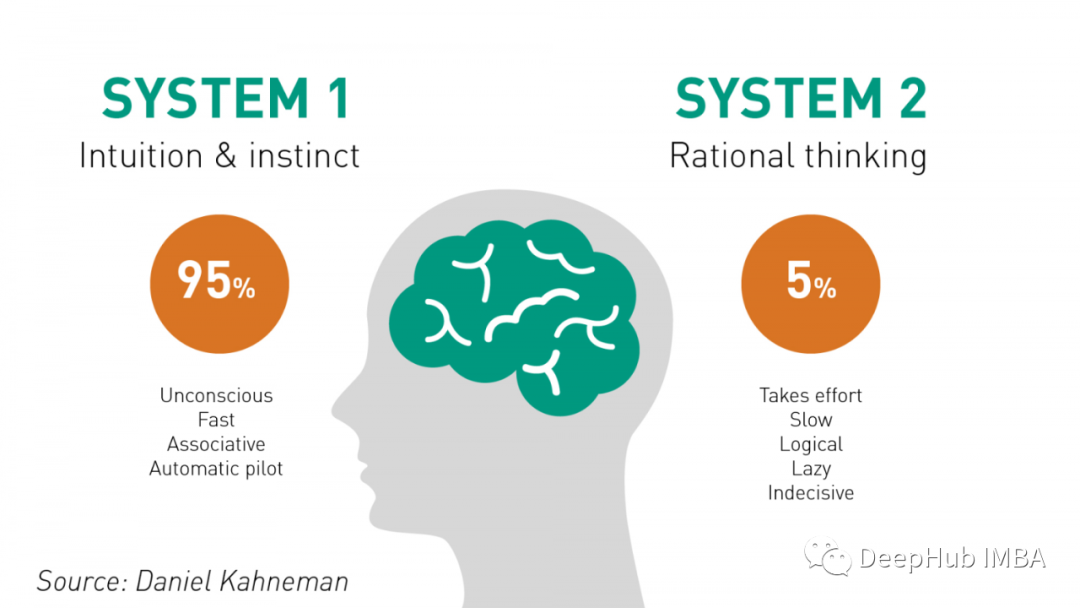

- 系统1(System 1): 这是一种快速、直觉性、自动的思考方式。它是我们在处理日常事务时采用的那种直觉反应,几乎是无意识的。系统1负责快速做出决策,识别模式,感知情绪等。然而,它有时候可能会导致错误,因为它更容易受到情感和直觉的影响。

- 系统2(System 2): 这是一种更为缓慢、深思熟虑、理性的思考方式。当我们面临更复杂、挑战性的问题时,系统2被激活。这种思考方式需要更多的认知努力,包括逻辑分析、推理和意识层面的思考。系统2更能够进行深度思考,但也更耗费时间和精力。

https://avoid.overfit.cn/post/4d6dae0510b44b779668dc4ab51108e9