我们通过几个例子直观体会如何运作。

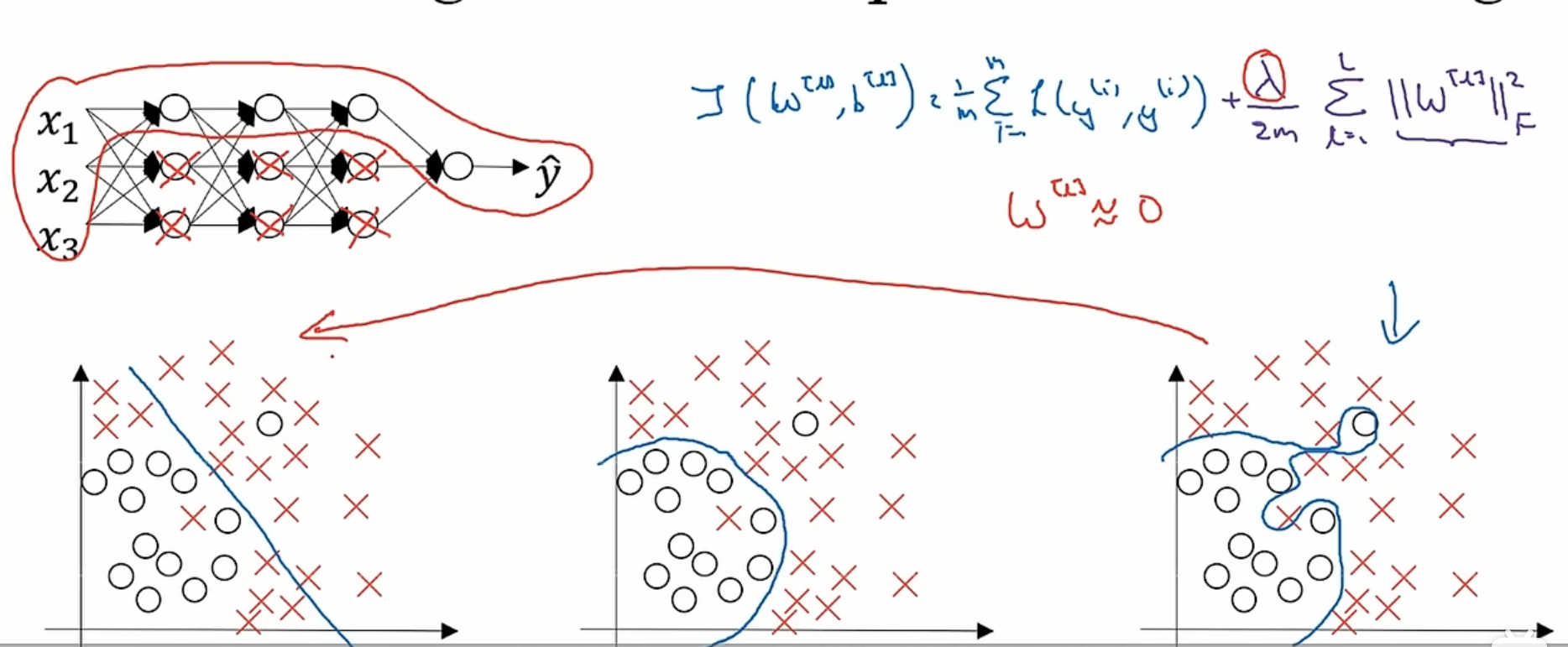

通过对神经网络的代价函数进行正则化,我们为什么可以解决过拟合???

一个比较直观的解释就是,当我们把λ 设置的非常大,权重矩阵w就会被设置为非常接近0的值,这个直观的理解就是把很多隐藏神经元的权重几乎设置成0了,这就导致这些隐藏神经元的影响被消除了,神经网络被大大简化了,从一个非常庞大的神经网络,从一个能够把训练集拟合的很好的神经网络变成一个规模变小的神经网络。这个算法会接近逻辑回归算法,也就是二分方法。

但是也有可能,我们的λ选择的太大,导致w矩阵太小,我们的神经网络太简单以至于不能很好的拟合数据,变成了更加接近欠拟合的状态。但是不用担心,λ存在一个中间值能够让图像变得“just right”

tanh函数: