requests

requests 下载大文件

# -*- coding: utf-8 -*- from contextlib import closing from requests import get url = 'https://www.test.video/aa' # 但是使用with语句的时候是需要条件的,任何对象,只要正确实现了上下 ......

JMeter中获取Request内容写到Txt文件中

JMeter中获取Request内容写到Txt文件中 参照文档 https://blog.csdn.net/chenqinglanhao/article/details/124125435 import java.net.URLDecoder;import org.json.*; //String ......

Splash与requests结合

Splash与requests结合 render.html 此接口用于获取JavaScript渲染的页面的HTML代码,接口地址就是Splash的运行地址加此接口名称,例如http://localhost:8050/render.html import requests def func1(): ' ......

记录 python request ProxyError报错

【出自】:https://zhuanlan.zhihu.com/p/350015032 侵删 解决办法:在原报错环境中使用下面命令重装低版本 urllib3: pip install urllib3==1.25.11 问题根源 先查了一下 urllib3 的更新日志,应该是 1.26.0 的修改导致 ......

Application Request Routing 反向代理配置示例

第一步:安装URL Rewrite 第二步:安装Application Request Routing 下载地址:x86 installer / x64 installer第三步:配置 效果图: 对应配置文件 <?xml version="1.0" encoding="UTF-8"?><config ......

requests.exceptions.ProxyError: HTTPSConnectionPool(host='xxx', port=443)

# 绕过系统设置的代理 # 方法一: session = requests.Session() session.trust_env = False response = session.get('http://ff2.pw') # 方法二:(多人亲测可以直接结局这个问题) proxies = { " ......

python + requests:请求头('Content-Type': 'multipart/form-data'),并且files和其他参数均正确定义,但是文件上传一直失败,需要使用MultipartEncoder

### 解释 1. 在使用'Content-Type': 'multipart/form-data'上传文件时,你需要将文件作为请求体的一部分进行传输。而由于文件可能非常大,因此需要将文件分成多个部分进行传输。这就需要使用多部分编码(Multipart Encoding)来将文件分割成多个部分,并将 ......

request模块

一、request模块介绍和安装 1.安装request模块: win+R 后出入cmd 打开命令行窗口:输入 pip install requests。 2.在pycharm中,设置--项目--Python解释器中选择新增request模块。 二、request模块请求 1.get请求,heade ......

Python错误:requests请求https网站报错SSLError

问题描述: 用requests包请求https的网站时,经常会遇到证书问题,也就是常见的SSLerror: requests.exceptions.SSLError: HTTPSConnectionPool(host='www.xxx.com', port=443): Max retries exc ......

Python错误:requests请求设置verify=False时日志中有warning信息

问题描述: 在requests做请求的时候,为了避免ssl认证,可以将verify=False,但是这么设置会带来一个问题,日志中会有大量的warning信息, 如下面: D:\Program Files\Python\lib\site-packages\urllib3\connectionpool ......

Java中获取request对象的几种方法

1.通过注解获取(很简单,推荐): public class Hello { @Autowired HttpServletRequest request; //这里可以获取到request } 2.在web.xml中配置一个监听: <listener> <listener-class> org.sp ......

Jmeter访问网站返回403(CSRF verification failed. Request aborted.)

django网站自带CSRF校验,所以jmeter直接请求时会出现校验不通过的情况 ### 一、CSRF校验 CSRF是指跨站请求伪造,CSRF攻击的流程大概是我们登录网站A后存在本地的cookie,之后打开了另一个危险网站B,这个网站B使用本地cookie向网站A发起请求(该请求不是用户主动发起, ......

python-Requests库如何正确重试?

```python import requests from requests.adapters import HTTPAdapter, Retry session = requests.Session() retries = Retry(total=3, backoff_factor=1) ses ......

has been blocked by CORS policy: The request client is not a secure context and the resource is ...

该报错原因为:Chrome浏览器禁止外部请求访问本地,被CORS策略阻止解决方案:1、打开chrome的设置: chrome://flags/#block-insecure-private-network-requests2、将 Block insecure private network requ ......

elementUI中upload自定义上传行为 http-request属性

需求是上传一个xlsx后台处理完再返回xlsx流upload 请求需要添加responseType: 'blob' 属性所有要扩展一下 若依项目扩展elementUI中upload自定义上传行为 http-request属性 ``` 将文件拖到此处,或点击上传 仅允许导入xls、xlsx格式文件。 ......

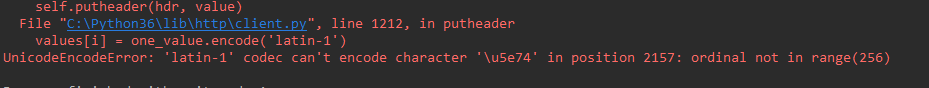

解决python中requests请求时报错:UnicodeEncodeError: ‘latin-1‘ codec can‘t encode character

当request请求中,带有中文,可能引发报错:  UnicodeEncodeError: 'latin-1' c ......

requests 请求网页乱码

一般情况下,每个网页有自己的编码,在使用 requests 请求对应网页时,如果遇到中文编码的问题,大多数情况下直接显式指定 encoding 就可以了,但是今天遇到一个网站,还真是怎么指定都不行:https://www.medchemexpress.cn/ 以下所列的参考文档可能能解决编码问题,所 ......

configure: error: udev support requested but libudev header not installed

./configure --host=arm-none-linux-gnueabi 错误提示:configure: error: udev support requested but libudev header not installed 解决办法 --disable-udev 取消对libude ......

高速——request请求

为防止服务器响应缓慢,导致客服端处理异常,requests请求大多设置 timeout 参数。Requests中timeout不设置默认值。 **读取超时**是没有默认值的,如果不设置,程序将一直处于等待状态。我们的爬虫经常卡死又没有任何的报错信息,原因就在这里了。 ## Timeout 类型: 超 ......

Scrapy_Request对象Cookie的演示

Cookie的使用 import scrapy class CookieSpider(scrapy.Spider): name = "爬虫名" allowed_domains = ["域名.com"] start_urls = ["url地址"] def start_requests(self): ......

Scrapy_Request对象dont_filter演示

import scrapy class BaiduSpider(scrapy.Spider): name = "baidu" allowed_domains = ["baidu.com"] start_urls = ["https://baidu.com"] def parse(self, resp ......

Scrapy_Request对象meta演示

request里面的meta 的使用 import scrapy class Xs2Spider(scrapy.Spider): name = "爬虫名" allowed_domains = ["域名"] start_urls = ["url地址"] def parse(self, response ......

Invalid character found in the request target [/api/hsFile/download?filePath=E:\\%E4%B8%B4%E6%97%B6%E6%96%87%E4%BB%B6&fileName=aaaaa.xlsx]. The valid characters are defined in RFC 7230 and RFC 3986

java.lang.IllegalArgumentException: Invalid character found in the request target [/api/hsFile/download?filePath=E:\\%E4%B8%B4%E6%97%B6%E6%96%87%E4%BB ......

requests Python中最好用的网络请求工具 基础速记+最佳实践

requests 模块是写python脚本使用频率最高的模块之一。很多人写python第一个使用的模块就是requests,因为它可以做网络爬虫。不仅写爬虫方便,在日常的开发中更是少不了requests的使用。如调用后端接口,上传文件,查询数据库等。本篇详细介绍requests的使用。 ......

Scrapy 中 Request 的使用

爬虫中请求与响应是最常见的操作,Request对象在爬虫程序中生成并传递到下载器中,后者执行请求并返回一个Response对象 一个Request对象表示一个HTTP请求,它通常是在爬虫生成,并由下载执行,从而生成Response 参数 url(string) - 此请求的网址 callback(c ......