Unsupervised Degradation Representation Learning for Blind Super-Resolution文献阅读

(2022.09.28)盲超分辨率的退化表征(向量)学习

摘要:大多数基于CNN的SR都是基于退化固定且可知这一假设。但是实际退化和假设不一致时这些方法的性能严重下降。以前处理实际应用中的各种未知退化是依赖退化估计来重建SR图像。然而退化估计很耗时且当估计误差大较大时,会导致SR失败。本文针对没有明确退化估计的盲SR,提出了一种无监督退化表征(向量)学习方案。具体而言,这种方案学习抽象表示在表示空间来区分各种退化而不是在像素空间的显式估计。而且,本文引入了一种基于学习表示的SR退化感知网络(DASR),该网络能够灵活适用于各种退化。结果表明,这种退化表征(向量)学习方案能够提取判别表示以获取准确的退化信息。在合成和真实图片上达到最好的效果。

1、介绍

SR和退化模型有高耦合。

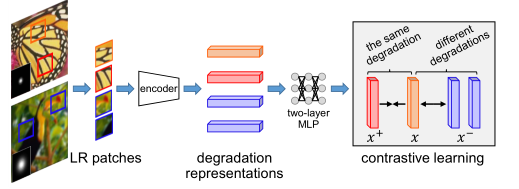

图无监督退化表征(向量)学习方案

为了处理现实中各种退化问题,提出了几种方案研究非盲SR。{前人方法一}具体来说就是采用一组退化(不同高斯模糊、运动模糊和噪声组合)来训练并假设测试LR图像的退化在推断时是已知的。{处理情形:}当真正的退化事先已知时,这些非盲SR方法能产生较好的SR结果。{缺陷:}为了超分辨带有未知退化的真实图像,需要执行退化估计给非盲SR网络提供退化信息。但是非盲方法对退化估计敏感。因此,估计误差会被SR网络进一步放大,导致明显的伪影。为了解决这一问题,Gu等人提出了一种迭代核校正方法(IKC),{前人方法二:}通过观察以前的SR结果来校正估计的退化。通过迭代修正估计,能够逐渐获得无伪影结果。{两个方法的缺陷:}由于退化估计和迭代核校正法在测试时都需要多次迭代,这些方法非常耗时。

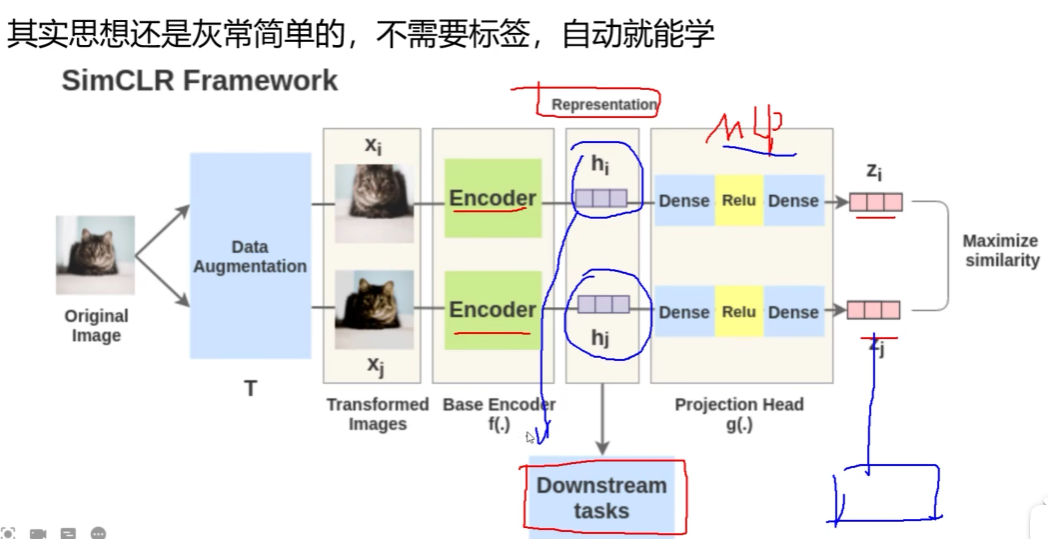

和以上明确地从LR图像估计退化的方法不同,本文通过学习一个退化表征(向量)来研究不同方法,以区分潜在的退化和其他退化。受到对比学习进展的激励,通过对比潜在空间的正负对得到的对比损失用来进行无监督退化表征(向量)学习。

退化表征(向量)学习的好处有两个方面:一、更容易学习抽象表示来区分不同的退化,可以获得一个有区别的退化表征(向量),以在单个推断中提供准确的退化信息。二、在无监督下运行,更适用于退化不知道的情况。

本文:图像中的退化是相同的,但不同的图像可能不同。同一张图片的不同patch的退化应该是相同的,不同图像的patch退化不同。提出一种灵活适用于不同退化的基于学习表示的退化感知SR网络。DASR结合退化信息,通过退化表征(向量)预测卷积核和通道注意力调制系数。

实际上就是用退化表示来得到卷积核和注意力权值。

来执行特征自适应。

- 相关工作

2.1

单一退化的SR

SRCNN、VDSR、EDSR、RDN、多此上下采样,提供反馈机制的采样层,自我校正;RCAN,SAN

多次退化的SR

SRMD(退化首次作为参数输入。在不同退化模型下SRlr图像),UDVD采纳动态卷积(这里的动态是指不同的退化下进行卷积吗)、USRNET(交替解决数据子问题和先验子问题处理不同的退化?先验子问题是什么?数据子问题是什么)、闭合形式校正滤波变换LR Image来匹配双三次退化生成的图像(是以双三为退化初始化形成SR然后....在和LR...对比改进在生成SR?)、现有的双三次退化训练网络可用于超分辨率转换后的LR图像(不太清楚什么意识,是指现在的一些LR图像经过SR后可以用双三次退化?)。Zero-shot方法也开始研究来实现SR的多重退化、ZSSR(在测试时以退化和LR图像作为输入训练)这个网络可以适应给定的退化,但是收敛慢非常耗时、MZSR中使用了基于优化的元学习,以使网络在推理中几次迭代就能适应特定的退化。上述方法将退化作为输入,因此高度依赖盲SR的退化估计方法。

2.2对比学习

以前的方法通过最小化输出和固定目标之间的差异来进行表示学习。对比学习是最大化表示空间的相互信息,不使用之前的预定义固定目标,查询样本的表征应该是吸引正对应同时排斥负对应。正对应可以是输入、输入的多个视图和同一个图像中的相邻补丁的转换版本。

本文将相同退化生成的图像patch视为正对体,通过对比学习得到内容不变的的退化表征(向量)。

- 方法论

- 问题公式化

这里是I(HR)是HR图像,k是模糊卷积核,两者进行卷积操作,箭头是下采样,s代表下采样级别,n表示额外的高斯噪声。

本文使用双三次下采样器执行下采样,首次研究具有各向同性高斯核的无噪声退化模型,然后研究具有各向异性高斯核和噪声的广义模型。

- 本文方法

盲SR框架由一个退化编码器核一个退化感知SR网络。

LR->退化编码器->表征(向量)

表征(向量)->DASR->SR图像

FC layer 是全连接层

3.2.1退化表征(向量)学习

目的是以无监督方式在LR图像中提取判别表征。退化表征学习使用对比学习框架。

本文假设同一张图片的退化相同,不同图片的退化不同。

模型过程:

橙色的正方形是一个图像的patch作为查询patch,红色的正方形是来自同一张图片的其他的patch,可以视为正样本;蓝色方框的patch是来自其他图像的,可以视为是负样本。

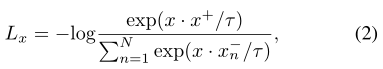

然后用一个六层的卷积层编码查询、正和负patchs为退化表征(一个向量),如图2编码器所示。然后将得到的结果表征进一步遣送到两层多层感知机(似乎就是全连接层,补一下感知机和全连接层的区别)映射到头得到x,x+,x-。鼓励x和x+相似同时鼓励x与x-不同。采用MOCO的InfoNCE损失来定义相似度函数。

没有做数据争强,让来自同意图片的是正样本,不同图像的为负样本

让正样本相似度越接近越好,负样本相似度越低越好。

用来做下有任务的是未经过全连接成处理的特征(原生特征的泛化能力要更强一点),因为经过全连接成对比的特征适应于分类问题的,是专门做相似度对比的,不适合做其他任务

防止模型坍塌,就要增加负样本的数量,要求batch非常大,必须负样本要比正样本多

N代表负样本的数目,τ是温度超参数,·代表点积

类似于交叉熵的损失函数进行监督

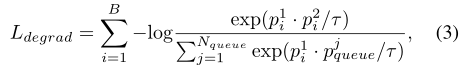

一个包含丰富负样本的大字典对于表征学习是至关重要的。为了后的内容不变的退化表征学习,要一个包含各种内容和退化的样本队列。训练时随机选取B张LR图片,然后在每张图片中随机裁剪2个patch,使用退化编码器将这2B个patch编码到{p1i,p2i 属于R256},对于第i个图像,p1i作为图形第一个嵌入。将p1i,p2i分别做查询和正样本。总体损失定义为如下:

这里N(queue)是指队列正样本的数量(数据是成对的,也就是有几对)p(j)<queue>是队列中第J个图片的负样本。

讨论:现存的方法要提取退化的完整表征(需要多次迭代),非常耗时。

本文的目的是学习一个好的抽象表征来区分特定退化,而不精确的估计退化。有效且高效可在一个单独的推理得到鉴别表征。不许groundtruth退化监督,无监督进行的。

3.2.2化感知SR网络

使用生成的表征来对LR图像进行SR。如图二

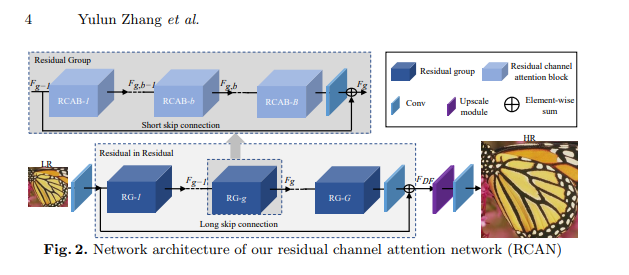

退化感知块(DA块)构建块,应用RCAN高层结构。

(RCAN主要由四部分组成:浅特征提取、residual in residual (RIR) 深度特征提取、上采样模块和重建部分。假设I(LR)和I(SR)表示为RCAN的输入和输出。)

DASR由5个Residual Groups,每一个group由5个DA块构成。每个DA块里面有两个DA卷积层来根据适退化表征适应特征。根据观测不同恢复级别训练的模型的卷积核具有相似的模式但具有不同的统计量,将退化表征R输入两层全连接层(FC layer)然后经过重塑层(reshape layer)生成深度卷积(deptch-wise)的卷积核W(Cx1x3x3)。

输入特征F采用之前预测得到的卷积核做深度卷积,然后再做一个pointwise卷积(卷积核为1x1)得到F1。受到CresMD(使用控制变量法来缩放不同通道以处理多个降级)启发,DA卷积层学会基于退化表示生成调制系数来执行通道方面的特征自适应。

退化表征经过一个全连接层得到R,R经过两个FC layer 和一个sigmoid激活层生成通道注意力调制系数V。然后用V缩放F的不同通道组件产生F2,最后将F1和F2相加传入下一层以生成Fout。

RCAN结构图

RCAN结构图

讨论:直接将退化表征和图像作为整体处理会因为彼此的域差引入干扰。本文通过学习预测卷积核和调制系数的基础退化再现,DASR可以很好地利用退化信息来适应特定的降解。DASR得益于DA卷积,以更好地SR性能实现对各种退化的灵活适应。

- 实验

4.1数据集和实现细节

通过公式一来合成LR图像用来训练和测试(本文的所有实验都是基于低分图像是这个模型合成,图像的退化并不是一无所知,而是有一个固定的数学模型)。训练集是DIV2K中的800张训练图片和Flickr2K中的2650张训练图像,验证集使用Set5,Set14,B100和Urban100。现在网络(DASR)首先在关于各向同性高斯核的无噪声退化上训练。对于缩放倍数(x2/3/4)SR,高斯核的核宽度σ分别在[0.2,2.0], [0.2,3.0] 和

[0.2,4.0]范围中设置。然后在更一般的带有各项异性高斯核和噪声的退化上训练。

下面的一些设置还不是很懂,似乎是高斯的协方差矩阵由决定两个在(0.2,4)之间取的随机参数和一个在(0, π)取的随机旋转角度θ,噪声水平设在(0,25)之间。

- 结论

提出一种盲SR的无监督退化表征学习策略来解决各种退化。不精确的估计退化,使用对比学习提取有辨识力的特征来区分不同的退化。引入了一个DASR网络,能够根据学习到的表征灵活适应不同退化。

- Representation Unsupervised Degradation Learningrepresentation unsupervised degradation learning representation unsupervised momentum contrast representation incremental classifier learning nonequilibrium thermodynamics unsupervised learning representation sparsification learning robust representation generative synthesis learning image representation continuous learning unsupervised ego-motion learning motion unsupervised embedding learning word unsupervised adaptation weighted learning