预测股票价格指数的实际波动率 CEEMDAN 和 LSTM 的混合模型

波动率:波动率是金融资产价格的波动程度,是对资产收益率不确定性的衡量,用于反映金融资产的风险水平。波动率越高,金融资产价格的波动越剧烈,资产收益率的不确定性就越强;波动率越低,金融资产价格的波动越平缓,资产收益率的确定性就越强。

现实的波动率(RV)金融时间序列是非线性的、不稳定的和有噪声的。用单一的预测模型想要精准的预测RV是不容易的。

-

-

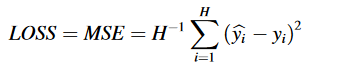

采用四个损失函数MSE、MAE、HMSE、HMAE和模型置信度集(MCS)检验作为评价标准

-

采取反向传播神经网络(BP)、Elman神经网络(Elman)、支持向量回归机(SVR)、自回归(AR)、异质自回归(HAR)及其混合模型并与CEEMDAN进行比较

-

结果表明CEEMDAN-LSTM在新兴市场和发达市场的预测效果最好,并且单个模型不如带有CEEMDAN的混合模型

介绍

波动率除了是金融市场风险的衡量标准,而且在资产定价和投资组合中起着至关重要的作用。早年,学者们普遍集中对低频波动的预测,然而低频波动不可避免的包含大量噪声,低频波动的预测结果不能作为参考。1998年Andersen和Bollerslev两个人在高频数据构成的以现实波动率\现实方差做出了重要贡献。现实波动率RV具有信息量大、噪声小、无偏、鲁棒性好等优点,已成为测量实际波动率的重要手段。

当RV被首次提出时,已经有很多关于低频波动的模型,比如自回归模型(AR)、自回归移动平均模型(ARFIMA)、随机波动率(SV)。之后更多的模型被明确地构造用于RV预测比如:异质自回归已实现波动率模型(HAR),此模型形式简单具有捕捉“程式化事实”的优势,如长记忆和多行为,因此很多人着重于HAR模型的及其扩展进行研究。

近些年来随着人工智能的快速发展,深度学习算法在各个领域的发展,与传统的计量经济学模型相比,深度学习算法具有更少的限制和特征提取的强度,于是学者们开始探索将深度学习应用到RV预测的可行性。

在探索的过程中. McAleer 和 Medeiros (2011)做出了一种基于神经网络的非线性HAR模型。Arneri ́c, Poklepovic ́和 Teai (2018)比较了HAR和前馈神经网络,最后得出结论,将二者结合的FNN-HAR型模型才可以更好的捕捉RV的非线性特征

后面发现于前馈性神经网络不同的是,RNN循环神经网络中有允许信息持久性的回路结构,所以更适合于金融时间序列的处理。现已知RV具有长记忆性,LSTM作为RNN的一种改进变体,可以在更长的时间范围内捕捉时间序列特征。所以理论上,LSTM会更适合RV预测。

以往的研究发现,分解算法可以将噪声部分从原始时间序列中分离出来,从而提高精确度。因此,选择合适的分解方法是非常重要的

虽然经验模式分解(EMD)可以处理高度复杂和不规则的数据,但它仍然有一个缺陷:模式混合,于是集成经验模式分解(EEMD)被提出用来通过将高斯白噪声添加到原始序列来修复模式混合。但是发现白噪声的加入也带来了一个新的问题重建误差无法消除。后来又提出来了CEEMDAN来解决这个问题

于是本文就采用将LSTM模型和CEEMDAN模型进行融合之后进行RV的预测,采用四个损失函数MSE、MAE、HMSE、HMAE和模型置信度集(MCS)检验作为评价标准,将CEEMDAN-LSTM与另外10个模型进行性能比较。总的来说,本文旨在通过实证研究回答两个问题:

-

CEEMDAN-LSTM能否精确的预测RV

-

假设可以精确的预测RV,那么CEEMDAN-LSTM在新兴市场和发达市场的表现是否是最好

方法

CEEMDAN

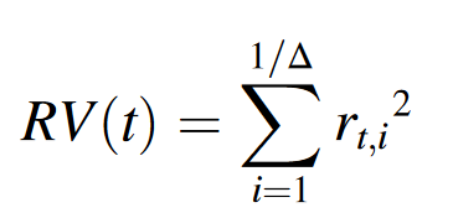

本实验中,采用股票指数的日内收益来构造日RV,对于给定的某天t,RV(t)是日内高频平方回报的总和:

其中Δ是抽样间隔,1/Δ是抽样数,r表示第t天的第i次日内日回报

为了减少噪声对RV预测的影响,对原始序列RV(t)进行分解。

EMD假设每个级数由几个本征模态函数(IMF)和一个残差组成,这几个本征模态函数必须满足:

-

在整个数据集中,极值(最大值和最小值)的数量等于容量差为1的过零点数量

-

在任一点,由局部极大值定义的包络(上包络),和由局部最小值定义的(下包络)必须服从零均值条件

EEMD通过在原始序列中加入高斯白噪声,在一定程度上克服了EMD的模式混合问题。此外,与EEMD相比,CEEMDAN几乎消除了重建误差。

长短期记忆

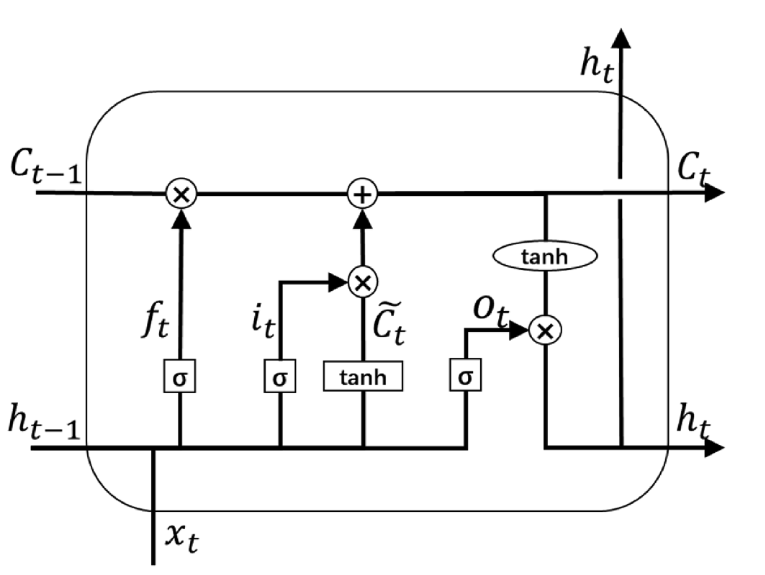

在LSTM中,三个门的应用和单元状态使得LSTM很容易复位、更新和保存长期信息。在图中,穿过顶部的水平线是单元状态Ct,而最下面的是一个隐藏状态ht,xt是LSTM在第t天的输入,其单元的过程:

-

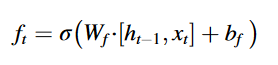

第一步先确定单元状态Ct-1的哪一部分将会被遗忘,决定可以由忘记门层做出:(其中w是权重矩阵,b是偏差,σ是一个sigmoid层,它将预测的值放在0(完全忘记)和1(完全保留)之间)

-

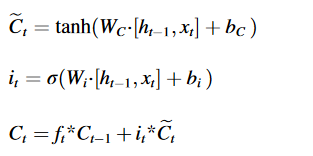

下一步是更新单元状态。输入门层将决定候选单元的哪一部分可以更新到新单元的状态Ct

运算符tanh被定义为将值推送到-1和1之间的tanh层,*代表哈达玛积

-

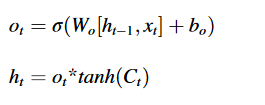

最后一步是输出,其中输出门起作用

本文应用的LSTM结构,结构如下:

-

第一层是输入层,在第t天的输入是Xt,对应的标签是xt+1,liangge LSTM层的神经元分别设置为128和64

-

第二层连接到一个具有16个神经元的全连接层,然后,完整的连接层将连接到只有一个神经元的输出层.

-

所有层的激活函数都是ReLU函数,因为它比sigmoid函数和tanh函数具有更快的计算速度,还重新解决了正区间内的梯度消失问题,为了防止过拟合,采用了dropout,其参数设置为0.5(其创造者给出的默认值是0.2),此外均方差被用作是损失函数,其中H是训练集的长度

想要将LSTM模型进行优化,本文考虑到从输入集进行改进,将输入集通过CEEMDAN算法进行处理之后,得到了n+1个子级数IMF和一个残基R(t).

本文采用滑动窗口机制所谓稳健性检验方法来检验模型在不同数据集上的预测性能,于是在实证部分采用整个数据集的前90%数据,然后将每个字系列7:1:1划分为训练集,验证集和测试集。将训练集放入LSTM作为输入,验证集用于测试模型的泛化能力,最后用测试集得到预测结果。

- Forecasting integrating volatility realized CEEMDANforecasting integrating volatility realized ceemdan realized forecasting pytorch-forecasting forecasting methods series time forecasting ensembling enhancing concept convolutional forecasting generic dynamic autoregressive probabilistic forecasting recurrent forecasting time-series long-term encoder