Life Long Learning(机器终身学习)

Selective Synaptic plasticity(选择性突触可塑性)

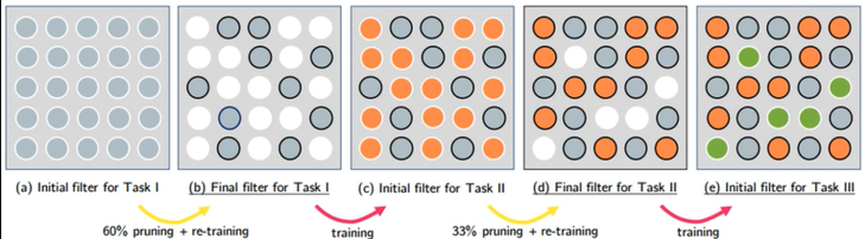

- 只让类神经网路中,某一些神经元或某些神经元间的连接具有可塑性(只有部分的连接是有可塑性的,有些连接必须被固化,不能改变或移动他的数值)

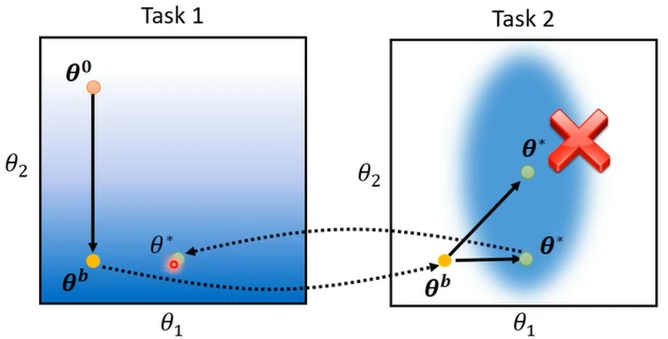

为什么会灾难性遗忘:

假设模型训练中有两个任务,模型有两个参数,蓝色越深Loss越小

θ0为参数初始值,经过任务一调到了θb,又经过任务二调到θ*,此时再进行任务一时,Loss就会变大:

得出,每个参数对过去学过任务的重要性不同,在学新任务时,那些重要的旧参数尽量不变,所以给每个参数一个guard(守卫,代表这个参数对过去任务的重要程度),记为b;

在更新参数时就需要改写Loss函数:在原基础上加(修改值平方*参数的重要程度值)

![]()

- 如何设置b:训练完一个模型后,看每个参数对这个任务的影响;例如:依次微调每个参数,看这个微调对结果的影响程度,b的值和这个影响成正比

Additional Neural Resource Allocation(额外的神经资源分配)

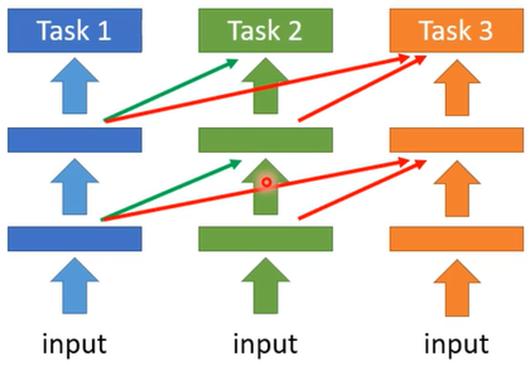

1、Progressive Neural Network(渐进式神经网络):训练任务一之后,在训练任务二,不动任务一的模型,再多开一个Network,吃任务一模型的输出作为输入,只新增一些额外的参数;缺点:每次新增任务都会扩大模型

2、PaclNet(包网):建一个大模型,每新增一个任务就启用其中一部分没有启用的结点(可以与Progressive Neural Network一起使用)

Memory Reply(记忆回复)

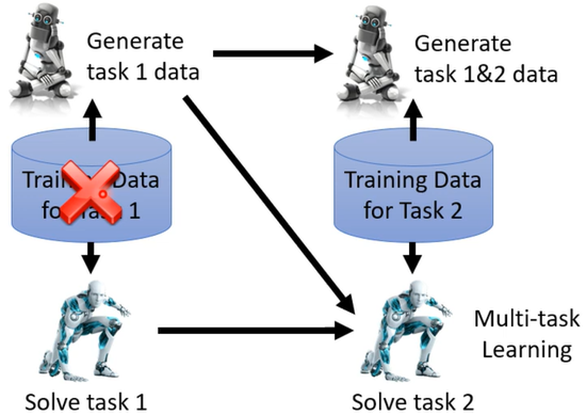

- Generating Data:另训练一个Generative的模型,用于把过去任务的训练资料在训练时及时产生出来;在训练任务二时,就把任务一Generative产生的资料和任务二资料一起进行训练,再训练Generative的模型;之后任务都类似

- 相当于拥有全部任务(各个阶段的任务)的训练资料