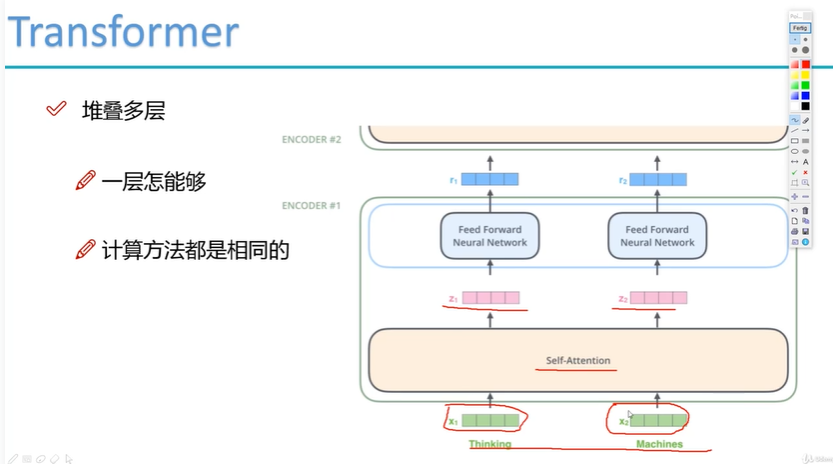

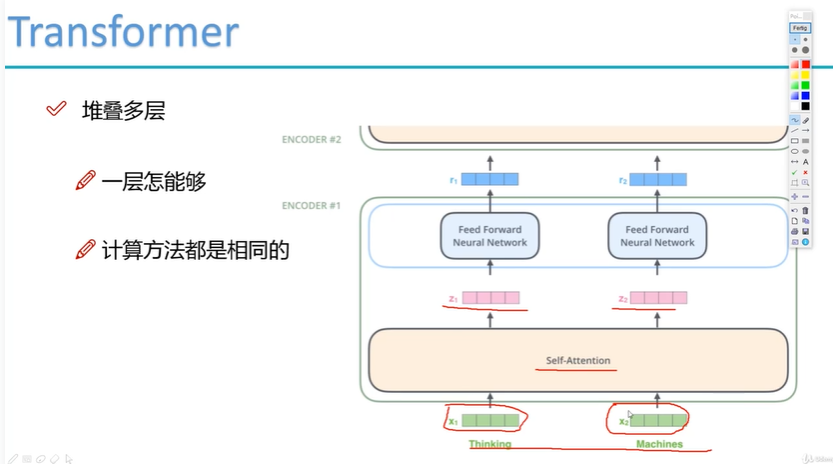

多层堆叠

多头得到到多个结果 z1 z2

z1 z2经过 feed forward neural network网络 全连接层得到向量r1 r2.

既然是向量,就可以重复输入网络了

然后就可以重复堆积层了。

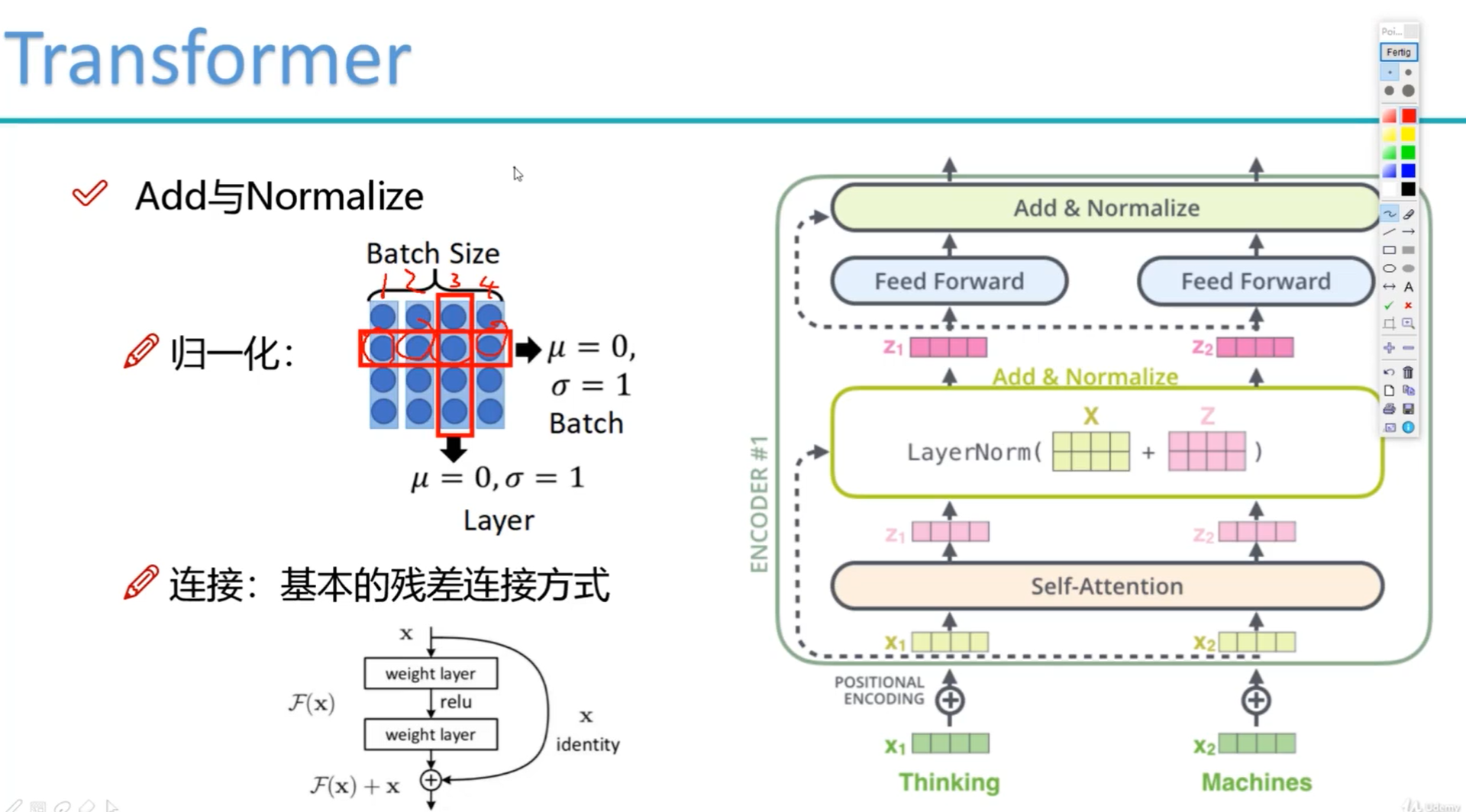

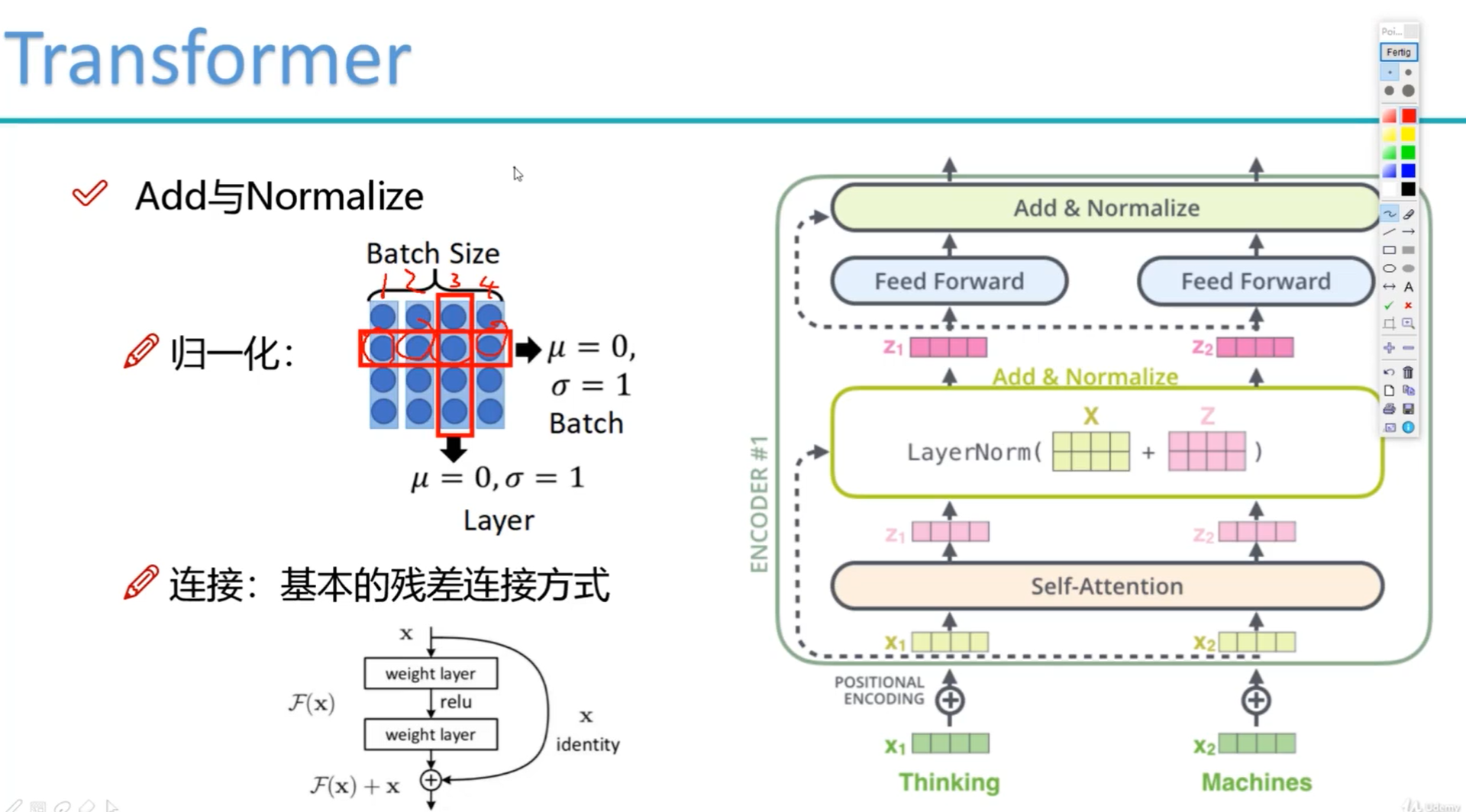

layernorm 应用了残差网络思想(确保加的层不会导致比原来系统差)

1 加操作:输出+输入,增加了输入有利于解决梯度消失

2 归一化:保证方差,均值稳定,减缓梯度爆炸

多层堆叠

多头得到到多个结果 z1 z2

z1 z2经过 feed forward neural network网络 全连接层得到向量r1 r2.

既然是向量,就可以重复输入网络了

然后就可以重复堆积层了。

1 加操作:输出+输入,增加了输入有利于解决梯度消失

2 归一化:保证方差,均值稳定,减缓梯度爆炸