手记chatglm cpp

Langchain-Chatchat项目:1.1-ChatGLM2项目整体介绍

ChatGLM2-6B是开源中英双语对话模型ChatGLM-6B的第2代版本,引入新的特性包括更长的上下文(基于FlashAttention技术,将基座模型的上下文长度由ChatGLM-6B的2K扩展到了32K,并在对话阶段使用8K的上下文长度训练);更高效的推理(基于Multi-QueryAtte ......

【Cpp】RTTI 机制原理解析

References Baidu Wiki C++中的RTTI机制详解 RTTI 推荐阅读: RTTI 原理 推荐阅读:C++中的RTTI机制 什么是RTTI机制? RTTI 是“Runtime Type Information”的缩写,意思是:运行时类型信息。它提供了运行时确定对象类型的方法。 R ......

Cpp 惯用法 CRTP 简介

From Wikipedia, The curiously recurring template pattern (CRTP) is an idiom, originally in C++, in which a class X derives from a class template insta ......

Windows桌面应用程序源文件.cpp注释

这个是visual studio 2022上利用 Windows桌面应用程序模板创建的源文件注释 一个Windows图形界面(GUI)应用程序通常由主窗体,对话框,控件组成。 当应用程序创建一个窗体,需要调用CreateWindowEx函数,必须提供的参数1.窗体类窗体类是一个结构体。是一系列属性的 ......

MaSuRCA 软件安装 swig/perl5/swig_wrap.cpp:342:20: fatal error: string.h: No such file or directory

001、问题 MaSuRCA 软件安装 swig/perl5/swig_wrap.cpp:342:20: fatal error: string.h: No such file or directory 002、原因, 当前环境处于conda的base环境,可能是函数库调用混乱。 003、解决方法, ......

C和CPP程序是如何运行起来的?

C和CPP程序是如何运行起来的? 个人见解,谨慎阅读。 如有错误,欢迎指正! 代码均在Linux下编译运行。 1. C语言程序从源码到可执行文件的过程 C语言程序从源码到可执行文件的过程主要分为以下几个步骤:预处理、编译、汇编、链接。 flowchart LR A1[代码] --"预处理"--> B ......

[CPP] CPP的编译链接过程

手写的源代码本质上只是一串文本, 但是在编译器里点一下编译就可以直接看到程序的输出,从文本到执行输出之间发生了什么 源代码到可执行程序大致经历以下几个过程 1、 预编译(Preprocessing) 预编译阶段主要做四件事: 头文件展开, 宏替换, 执行预编译指令, 移除代码中的注释 2、 编译(C ......

cpp: read .dat file

/// <summary> /// 打开DAT 文件 /// </summary> void operatefile() { char data[100]; const char* fname = "afile.dat"; // 打开文件. ofstream outfile; outfile.ope ......

ChatGLM2

下载chatglm2-6b print('开始加载分词器tokenizer...') tokenizer = AutoTokenizer.from_pretrained("THUDM/chatglm2-6b", trust_remote_code=True) print('开始加载语言模型model ......

ChatGLM-6B-PT微调

目录开发环境ChatGLM2-6B源码下载模型安装依赖下载ADGEN数据集微调前修改训练步数微调后 开发环境 矩池云 https://www.matpool.com/host-market/gpu ChatGLM2-6B源码 https://github.com/THUDM/ChatGLM2-6B ......

cpp: Sorting Algorithms

/*****************************************************************//** * \file SortingAlgorithms.h * \brief 排序 * \ IDE vs 2022 C++ 20 * \author geovin ......

使用Triton部署chatglm2-6b模型

一、技术介绍 NVIDIA Triton Inference Server是一个针对CPU和GPU进行优化的云端和推理的解决方案。 支持的模型类型包括TensorRT、TensorFlow、PyTorch(meta-llama/Llama-2-7b)、Python(chatglm)、ONNX Run ......

CPP面向对象笔记

基本 属性 即在类中包含的一系列变量 方法 即在类中定义的一系列函数 Public, Private and Protected 在没有继承的情况下,private 与 protected 效果相同 即都无法在类外直接访问调用 实在想要访问,加个函数就行 public 则可以随意访问调用 stati ......

本地部署 Langchain-Chatchat & ChatGLM

一、模型&环境介绍 1. ChatGLM github 地址:https://github.com/THUDM 模型地址:https://huggingface.co/THUDM 2. m3e 模型地址:https://huggingface.co/moka-ai/m3e-base/ 3. text ......

swig/perl5/swig_wrap.cpp:763:20: fatal error: EXTERN.h: No such file or directory

001、问题 002、解决方法 (base) [root@pc1 MaSuRCA-4.1.0]# yum -y install perl-devel 参考:https://www.likecs.com/ask-702675.html 。 ......

CPP Tutorials for Beginners

CPP Tutorials for Beginners, Mosh, Youtube IDE: CLion Env: C++20 #include <iostream> #include <cmath> #include <cstdlib> void const_var(); void create ......

C模拟CPP的方法重写(override)和多态

1. 所谓override,就是子类中重新实现了父类中的某一方法(子类和父类的同一个方法的方法体不同) 2. 所谓多态,最显著的一个特点就是父类指针指向不同的子类对象时,运行同一个方法会有不同的行为 3. C语言模拟继承时,父类对象必须是子类对象的第一个成员 4. 理解了C的父类结构体指针子类结构体 ......

16G内存+CPU本地部署ChatGLM2/Baichuan2推理(Windows/Mac/Linux)

概述 本文使用chatglm.cpp对中文大语言模型(LLM)进行量化与推理,支持ChatGLM2-6B、Baichuan2-13B-Chat等模型在CPU环境16G内存的个人电脑上部署,实现类似ChatGPT的聊天功能。支持的操作系统包括Windows、Mac OS、Linux等。 其中,量化过程 ......

解决 ChatGLM.CPP+clBlast 编译错误(也适用于SD.CPP)

首先安装 OpenCL 和 clblast: vcpkg install opencl clblast 下载GitHub 上的源码: git clone --recurse-submodules https://github.com/li-plus/chatglm.cpp cd chatglm.cp ......

24届 CPP 菜鸡选手秋招 0 offer 记录

简历信息: 绩点:年级前10%,专业课一半满绩点 竞赛:ICPC/CCPC银,蓝桥杯C++ A组国一(都是大一打的) 实习: 阿里妈妈:内容不太多,但有一定工作量(cache 相关,偏底层,面试官一般不感兴趣,会问但往往不会深入问,导致看起来毫无难度) 华为:比较水,主要是研究各种哈希表和实现无锁哈 ......

c/cpp: main() - envp

c/cpp: main() - envp 1. main(int argc, char *argv[], char *envp[]) - envp 1 [wit@fedora null]$ cat envp_main.c 2 #include <stdio.h> 3 #include <stdlib ......

C与CPP常见编译工具链与构建系统简介

笔者最近在研究CEF的CMake工程,心血来潮想要对各种编译工具链以及构建系统做一个简单的总结,于是就有了本文。本文不会讲解任何关于C/C++语言方面的内容,主要C/C++的编译出发,介绍各种编译工具链与构建系统的关系。此外,由于笔者水平有限,无法从非常专业的角度剖析C/C++的语言特性与编译,仅做 ......

cpp: vscode 配置C,C++

下载编译器MinGW并解压官网页面:https://www.mingw-w64.org/下载页面:https://sourceforge.net/projects/mingw-w64/files/ https://cmake.org/download/ 需要环境变量进行设置 task.json: { ......

LLamaSharp - .NET Binding for llama.cpp

https://github.com/SciSharp/LLamaSharp The C#/.NET binding of llama.cpp. It provides APIs to inference the LLaMa Models and deploy it on local environ ......

【3rd Party】Cpp 中使用 Protobuf

> 前置条件: > > * [【Protoc】VS2019 (VS平台) 使用 CMake 编译安装、使用 Protobuf 库 ](https://www.cnblogs.com/RioTian/p/17651778.html) > * [【ToolChains】CLion(VS2019) + C ......

windows vs使用grpc-cpp的坑

1.通过vcpkg安装protoc和grpc-cpp 2.生成proto协议代码: protoc -I .. -I . --cpp_out=. test.proto 3.生成grpc服务代码: protoc -I .. -I . --grpc_out=. --plugin=protoc-gen-gr ......

使用Nodejs的addon导入cpp生成的dll时出现的问题记录

## 在使用Nodejs的addon导入自己编写的cpp的dll时出现的一系列问题记录 标签: `__declspec`、`Napi`、`LoadLibraryA`、`GetLastError`、`dumpbin /exports`。 #### 正常创建一个使用Napi的nodejs addon项目 ......

chatglm2-6b在P40上做LORA微调

目前,大模型的技术应用已经遍地开花。最快的应用方式无非是利用自有垂直领域的数据进行模型微调。chatglm2-6b在国内开源的大模型上,效果比较突出。本文章分享的内容是用chatglm2-6b模型在集团EA的P40机器上进行垂直领域的LORA微调。 ......

[CPP专题]-编译,链接与静态动态库

# 本文施工状态 - [x] 单文件的编译 - [ ] 多文件的编译 - [ ] 静态库的编译与使用 - [ ] 动态库的编译与使用 # 本文有什么? 本文将使用简单的例子介绍如何编译和链接CPP代码,以及这些行为背后发生了什么改变。在此基础上介绍如何编译出静态库和动态库,以及如何使用这些库。适合对 ......

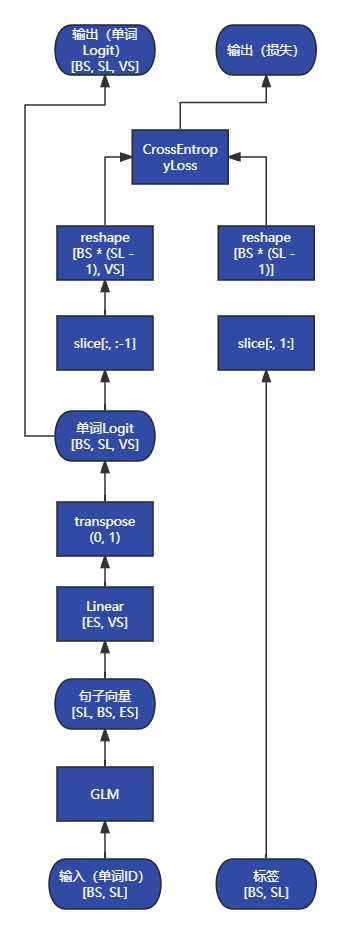

ChatGLM2 源码解析:`ChatGLMForConditionalGeneration.forward`

```py class ChatGLMForConditionalGeneration(ChatGLMPreTr ......