来源:如何理解Tesla和Wayve在CVPR2023 workshop上提到的world model? - EatElephant的回答 - 知乎 https://www.zhihu.com/question/610849510/answer/3108529249

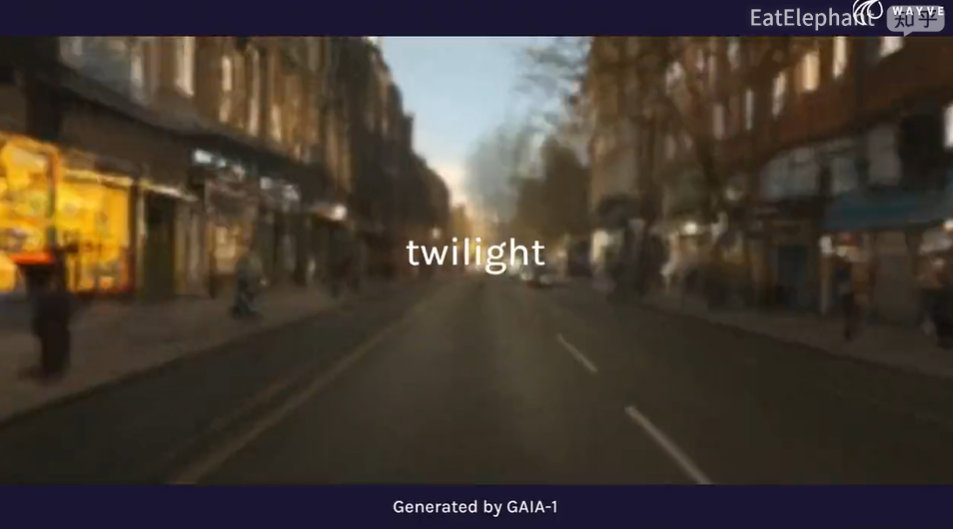

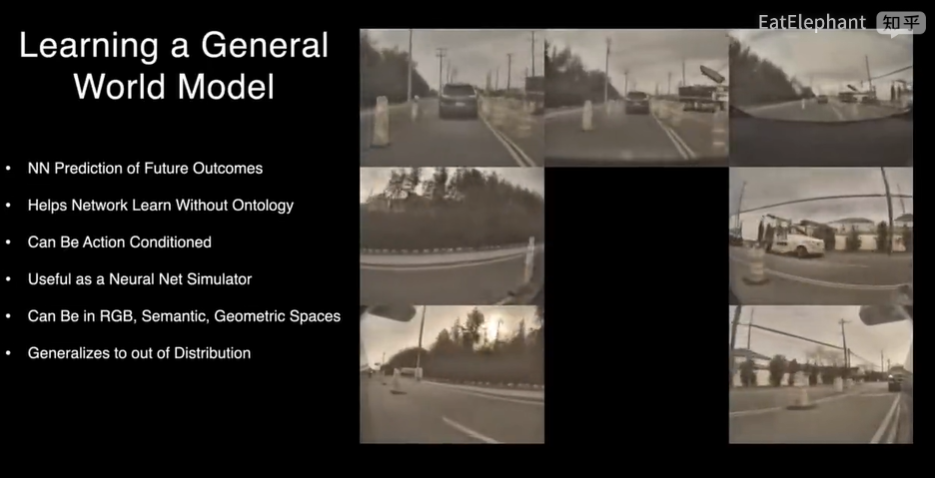

“CVPR 2023 自动驾驶workshop上Tesla和Wayve都提到了他们在利用生成大模型方面的最新探索方向,即大模型来生成自动驾驶相关的连续视频场景,Wayve将其命名为GAIA-1,并于前段时间发布,而Tesla则将自己的尝试命名为World Model。”

1. 从GPT说起

GPT为什么训的出来并且牛?

"之所以这样巨大规模的模型能够训练,离不开NLP领域发现了利用生成模型词语接龙或词语填空这样一个简单有效的自监督训练方法,利用这样的方法以及互联网上数千年来人类积累的海量文本数据,就可以训练出参数规模达到百亿千亿级别的性能卓越的巨大语言模型。"

所以,GPT的成功很大程度归结于它可以用文本的自监督特性,获得海量的训练数据(无需标注)。

但是CV领域都需要标注数据。很昂贵。

“与NLP领域相比,计算机视觉技术处理的图像拥有更加丰富的信息,俗话说一张图顶得上千言万语,但是计算机视觉领域一直缺乏文字接龙这样简单而又蕴含丰富信息的自监督任务”

所以,构建一个类似文字接龙的自监督任务,就可以让大模型类似于GPT一样获得海量的不用标注的训练数据。

在CV领域,很容易就想到根据当前场景预测未来场景。

“CVPR 2023 Tesla和Wayve展示的所谓World Model正是这种理念的产物。凭借自动驾驶车辆采集的大量实景视频数据,可以利用生成模型去生成未来场景来和真实的未来时刻数据对比,从而构建loss,这样就可以不依赖标注信息对模型进行训练。这个任务非常接近文字接龙"

"恰巧的是最近Elon Musk在Twitter上两次提到Tesla正在研究Diffusion Model,而且他们发现Diffusion可能比Attention更加高效。"

2. 自回归之争

杨立昆极力支持自监督训练,然而同时他反对自回归的训练。