一、什么是SVM

支持向量机(Support Vector Machine,SVM)是用于分类的一种算法,也属于有监督学习的范畴。

当一个分类问题,数据是线性可分(linearly separable)的,也就是用一根棍就可以将两种小球分开的时候,我们只要将棍的位置放在让小球距离棍的距离最大化的位置即可,寻找这个最大间隔的过程,就叫做最优化。但是,现实往往是很残酷的,一般的数据是线性不可分的,也就是找不到一个棍将两种小球很好的分类。这个时候,我们就需要球模拟成三维空间,然后找到将球分类的平面。而将球模拟成三维空间的这个东西就是核函数(kernel),用于切分小球的平面就是超平面(hyperplane)。如果数据集是N维的,那么超平面即使N-1维的。

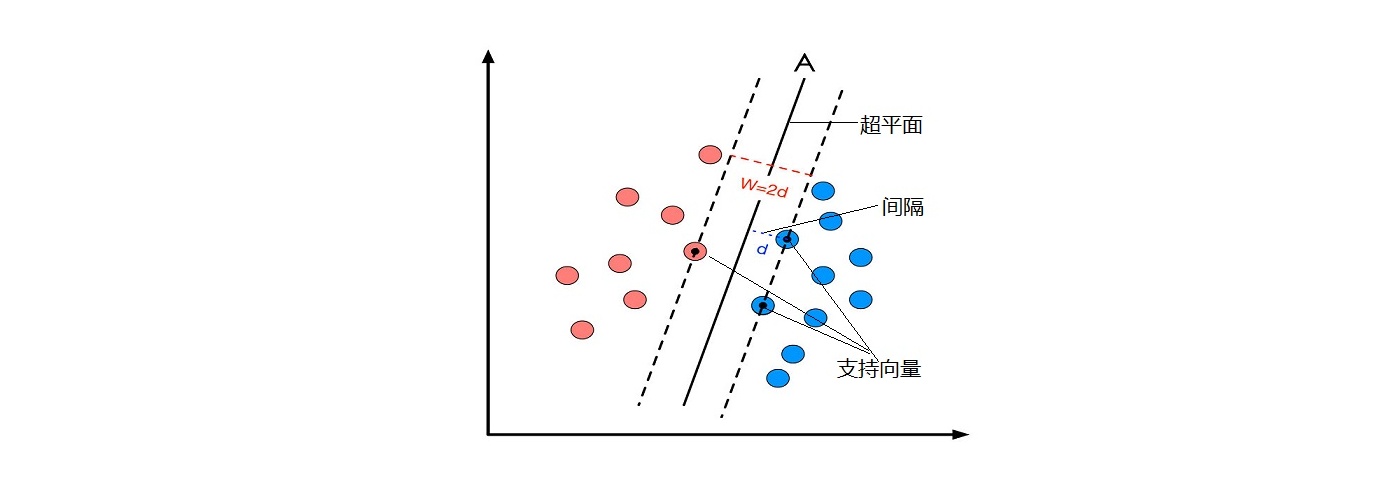

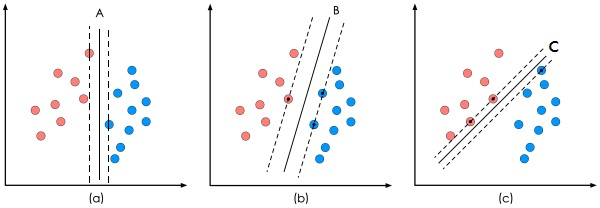

把一个数据集正确分开的超平面可能有多个(如下图),而那个具有“最大间隔”的超平面就是SVM要寻找的最优解。而这个正则的最优解对应的两侧虚线所穿过的样本点,就是SVM中的支持样本点,称为“支持向量(support vector)”。支持向量到超平面的距离被称为间隔(margin)。

二、线性SVM

1. 概述

一个最优化问题通常有两个最基本的因素:

① 目标函数,也就是你希望什么东西的什么指标大到最好;

② 优化对象,你期望通过改变哪些因素来使你的目标函数达到最优。

在线性SVM算法中,目标函数显然就是那个“间隔”, 而优化对象则是超平面。

我们以线性可分的二分类问题为例