conv1d conv1 torch conv

torch.all()

torch.all() 其中的所有项都为True,返回True,反之,返回False >>> import torch >>> a = torch.tensor([[1, 2], [3, 4]]) >>> b = torch.tensor([[1, 2], [3, 4]]) >>> a OUT: t ......

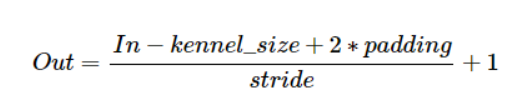

使用nn.Conv2d()和nn.MaxPool2d()调整输出的技巧

前提是没有使用dilation,牢记以下公式:  1.如果想保持张量大小不变,则:kenel_size=3(奇数), ......

torch的flatten函数

python:flatten()参数详解 这篇博客主要写flatten()作用,及其参数的含义 flatten()是对多维数据的降维函数。 flatten(),默认缺省参数为0,也就是说flatten()和flatte(0)效果一样。 python里的flatten(dim)表示,从第dim个维度开 ......

【d2l】【常见函数】【12】 torch.tensor.repeat( )

**Repeats this tensor along the specified dimensions.** 参考:https://pytorch.org/docs/stable/generated/torch.Tensor.repeat.html 参数说明、输入输出

**1.参数说明**  2.输入输出参数计算

**指定读取张量的设备,如GPU,CPU** 参考:https://blog.csdn.net/shaopeng568/article/details/95205345  返回标准正态分布张量

参考:https://pytorch.org/docs/stable/generated/torch.randn.html

**竖着或者横着拼接矩阵** 参考:https://www.cnblogs.com/JeasonIsCoding/p/10162356.html 参考:https://blog.csdn.net/qian2213762498/article/details/88795848 :注意事项

1。 当执行原地操作时,例如 tensor.add_(x),将会在一个张量上直接修改数据,而不会创建新的张量。由于修改了张量的数据,因此计算图会失效,即计算图中的操作和输入输出关系都会发生变化。这会导致反向传播无法正确计算梯度。因此,PyTorch 禁止在需要梯度计算的张量上执行原地操作。为了解决这 ......

pytorch使用(三)torch.zeros用法

#torch.zeros用法 torch.zeros() 是 PyTorch 中用来创建全 0 张量的函数。用法为 torch.zeros(size, out=None, dtype=None, layout=torch.strided, device=None, requires_grad=Fal ......

ConvE 学习笔记

[toc] # ConvE [paper](https://ojs.aaai.org/index.php/AAAI/article/view/11573) 这篇文章是瑞士大学的 Tim Dettmers 发表在 AAAI 2018 上的工作,提出了ConvE模型,使用了二维卷积应用到KGE,在此之后 ......

验证torch和torchvision安装成功

import torchprint("torch_version:",torch.__version__)print("cuda_version:",torch.version.cuda)print("cudnn_version:",torch.backends.cudnn.version())pr ......

机器学习 - Torch-TensorRT 推理加速

# 机器学习 - Torch-TensorRT 推理加速 Torch-TensorRT 作为 TorchScript 的扩展。 它优化并执行兼容的子图,让 PyTorch 执行剩余的图。 PyTorch 全面而灵活的功能集与 Torch-TensorRT 一起使用,解析模型并将优化应用于图的 Ten ......

PyTorch | torch.save()函数的使用

Pytorch保存模型等相关参数,利用`torch.save()`,以及读取保存之后的文件。 ### 函数信息 ```python torch.save(obj, f, pickle_module=pickle, pickle_protocol=DEFAULT_PROTOCOL,_use_new_z ......

torch中关于cuDNN的一些训练设置

torch.backends.cudnn.enabled = True cuDNN的非确定性算法(NP),等于True时启用,cuDNN设置为使用非确定性算法 torch.backends.cudnn.benchmark = True 再将benchmark设置为true,cuDNN将会自动寻找最适 ......

Pytorch | `torch.multiprocessing.spawn` 函数的使用

`torch.multiprocessing.spawn` 是 PyTorch 中用于启动多进程的函数,可以用于分布式训练等场景。其函数签名如下: ```python torch.multiprocessing.spawn( fn, args=(), nprocs=1, join=True, dae ......

深度学习单通道语音分离代码,卷积神经网络,torch代码。

深度学习单通道语音分离代码,卷积神经网络,torch代码。可以跑通的代码。语音分离,深度学习,分离两个人的单通道语音。ID:4850607593622211 ......

torch.nn.Module.register_forward_hook使用

本文简单介绍 torch.nn.Module.register_forward_hook钩子函数的使用,简单写了一个卷积的网络,在net.conv1.register_forward_hook注册钩子函数,则会有module、输入input数据与卷积后输出数据output,重点说明module是关于 ......

torch.nn.Module.register_forward_pre_hook使用

本文简单介绍 torch.nn.Module.register_forward_pre_hook钩子函数的使用,简单写了一个卷积的网络,在net.conv1.register_forward_pre_hook注册钩子函数,则会有module与输入input数据,重点说明module是关于模型结构se ......

pytorch的torch、torchvision、torchaudio版本对应关系

torch与torchvision对应关系 torch与torchaudio对应关系 ......

torch.randn(*tensor_shape, **kwargs)

` randn(*size, *, out=None, dtype=None, layout=torch.strided, device=None, requires_grad=False, pin_memory=False) -> Tensor Returns a tensor filled wi ......

人工智能创新挑战赛:海洋气象预测Baseline[4]完整版(TensorFlow、torch版本)含数据转化、模型构建、MLP、TCNN+RNN、LSTM模型训练以及预测

人工智能创新挑战赛:海洋气象预测Baseline[4]完整版(TensorFlow、torch版本)含数据转化、模型构建、MLP、TCNN+RNN、LSTM模型训练以及预测 ......

Pytorch torch.mean() 平均值的简单用法

Pytorch torch.mean()的简单用法 简单来说就是求平均数。比如以下的三种简单情况: import torch x1 = torch.Tensor([1, 2, 3, 4]) x2 = torch.Tensor([[1], [2], [3], [4]]) x3 = torch.Tens ......

在树莓派上实现numpy的conv2d卷积神经网络做图像分类,加载pytorch的模型参数,推理mnist手写数字识别,并使用多进程加速

这几天又在玩树莓派,先是搞了个物联网,又在尝试在树莓派上搞一些简单的神经网络,这次搞得是卷积识别mnist手写数字识别 训练代码在电脑上,cpu就能训练,很快的: import torch import torch.nn as nn import torch.optim as optim from ......

小灰灰深度学习day4——数据操作之张量(torch)

震惊了!!!在python中, y = x + y;与 y += x;竟然有区别,且看如下代码: import torch ''' x = torch.arange(12) print(x) #reshape可以改变张量的形状而不改变元素的数量和元素值 X = x.reshape(-1,3) pri ......

macbook苹果m1芯片训练机器学习、深度学习模型,resnet101在mnist手写数字识别上做加速,torch.device("mps")

apple的m1芯片比以往cpu芯片在机器学习加速上听说有15倍的提升,也就是可以使用apple mac训练深度学习pytorch模型!!!惊呆了 安装apple m1芯片版本的pytorch 然后使用chatGPT生成一个resnet101的训练代码,这里注意,如果网络特别轻的话是没有加速效果的, ......

ImportError: cannot import name 'QuantStub' from 'torch.ao.quantization' (E:\Eprogramfiles\Anaconda3\lib\site-packages\torch\ao\quantization\__init__.py)

ImportError: cannot import name 'QuantStub' from 'torch.ao.quantization' (E:\Eprogramfiles\Anaconda3\lib\site-packages\torch\ao\quantization\__init__. ......

安装python torch 遇到的问题

一、解决torch指令安装时Could not find a version that satisfies the requirement xxx (from versions: none) 1.进入torch的wheel下载网站https://download.pytorch.org/whl/to ......

torch+torchvision+cuda10.2

torch1.12.1 # CUDA 10.2 conda install pytorch==1.12.1 torchvision==0.13.1 torchaudio==0.12.1 cudatoolkit=10.2 -c pytorch # CUDA 10.2 pip install torch ......

torch.scatter

(22条消息) torch.scatter算子详解_leo0308的博客-CSDN博客 了解这个之前需要首先了解dim=0和dim=1的区别 dim=0 dim=1 我们看a 首先a,b是一个3×5的全零矩阵 对a执行scatter操作(将src中的值,按照指定的位置更新到input当中) 0.59 ......