space-channel compression contextual efficient

SHARPNESS-AWARE MINIMIZATION FOR EFFICIENTLY IMPROVING GENERALIZATION论文阅读笔记

Intro 在训练集上最小化损失很可能导致泛化性低,因为当今模型的过参数化会导致training loss的landscape异常复杂且非凸,包含很多local/global minima,因此优化器的选择至关重要。loss landscape的几何性质(特别是minima的flatness)与泛化 ......

CF1523C Compression and Expansion

前言 多测不清零,亲人两行泪。 题意 对于一个空的数字串,有两种操作: 删除末尾的 \(n\) 个 \((n \ge 0)\) 元素,并将修改后数字串的最后一个元素加一; 在数字串末尾添加一个数字 \(1\)。 输入 \(n\) 个元素,表示第 \(n\) 次操作后数字串末尾的元素。 思路 首先考虑 ......

QARV: Quantization-Aware ResNet VAE for Lossy Image Compression

目录简介创新之处模型结构实验结果 什么是Quantization-Aware量化感知? 简介 该文章基于VAE提出一种新的有损图像压缩方法,起名叫quantization-aware ResNet VAE (QARV). 这种方法集成了测试时间量化和量化感知训练,没有它就无法进行熵编码? 除此之外还 ......

LocPatcH An efficient long-read hybrid error correction algorithm based on local pHMM

该文档主要介绍了一种基于装配的方法和概率隐藏马尔科夫模型 (pHMM) 用于纠正长读序列的错误。文档详细描述了对酵母数据进行实验的结果、纠正方法的拓扑结构以及实验设置和数据集。 这种基于装配的纠正方法相对于直接纠正存在哪些优势? pHMM 的拓扑结构是怎样的? 在实验中使用了什么样的数据集? 提示: ......

FLAC: Federated Learning with Autoencoder Compression and Convergence Guarantee-2022

目的:减少通信量(成本),例如VGGNet架构具有大约1.38亿个参数(4264 Mb) 方法:具有自动编码器压缩(Autoencoder Compression)且具有收敛保证(Convergence Guarantee);利用冗余信息(the redundant information)和FL的 ......

CF1901E Compressed Tree 题解

原题链接:CF1901E,树形 dp + 神奇分类讨论。 很容易想到树形 dp。难点在于如何转移以及统计答案,需要大量分讨。 父亲(及其以上)和自己组成连通块,不缩。(只保留自己并且往上传递) 连通块中只有自己一个(记录答案) 一个儿子和自己组成连通块,且自己作为根节点,不和父亲收缩(记录答案) 一 ......

UNetFormer: A UNet-like transformer for efficient semantic segmentation of remote sensing urban scene imagery

UNetFormer: A UNet-like transformer for efficient semantic segmentation of remote sensing urban scene imagery * Authors: [[Libo Wang]], [[Rui Li]], [[ ......

Real-Time Single Image and Video Super-Resolution Using an Efficient Sub-Pixel Convolutional Neural Network

Real-Time Single Image and Video Super-Resolution Using an Efficient Sub-Pixel Convolutional Neural Network * Authors: [[Wenzhe Shi]], [[Jose Caballer ......

Segmentation Transformer: Object-Contextual Representations for Semantic Segmentation;OCRNet

Segmentation Transformer: Object-Contextual Representations for Semantic Segmentation * Authors: [[Yuhui Yuan]], [[Xiaokang Chen]], [[Xilin Chen]], [[ ......

High-Efficiency Lossy Image Coding Through Adaptive Neighborhood Information Aggregation

目录简介创新点内容Entropy Coding Using Multistage Context Model模型结构残差邻域注意力块Residual Neighborhood Attention Block RNAB激活函数 高斯误差线性单元激活函数GELU并行解码 简介 创新点 Integrate ......

The Devil Is in the Details: Window-based Attention for Image Compression

目录简介 简介 基于CNN的模型的一个主要缺点是 cNN结构不是为捕捉局部冗余而设计的,尤其是非重复纹理,这严重影响了重建质量。受视觉转换器(ViT)和Swin Transformer最新进展的启发,我们发现将局部感知注意机制与全局相关特征学习相结合可以满足图像压缩的期望。 介绍了一种更简单有效的基 ......

CF1901E Compressed Tree(树dp)

Problem 题目地址 Solution 来自fcy大佬的思路 记 \(f_u\) 表示假定以 \(u\) 为根的子树,在压缩后,(子树内的某一个点(包括 \(u\)))可以向外(除\(u\)为根的子树外所以点的集合)连一条边时的最大 \(sum\)。换言之,我们把树拆成 以\(u\)为根的子树( ......

VARIATIONAL IMAGE COMPRESSION WITH A SCALE HYPERPRIOR

abstruct 描述了一个变分自编码器的端到端图像压缩模型。这个模型结合了超先验来捕获潜在表示的空间依赖性,这种超先验涉及到了边信息。并且改模型与底层的自编码器结合联合训练一个复杂的先验。 introduction 熵编码依赖于编码器和解码器都知道的量化表示的先验概率模型(熵模型)。这种压缩潜在表 ......

Joint Autoregressive and Hierarchical Priors for Learned Image Compression

abstruct 最近的图像压缩模型基于自编码器,学习近似可逆的映射(从像素到量化的可逆表示),这些与熵模型(潜在表示的先验)结合,可以与标准算术编码算法一起使用产生压缩比特流。与简单的全因子先验相比,分层熵模型可以利用更多潜变量中的结构,从而在保存端到端优化的同时提高压缩性能。众所周知,自回归模型 ......

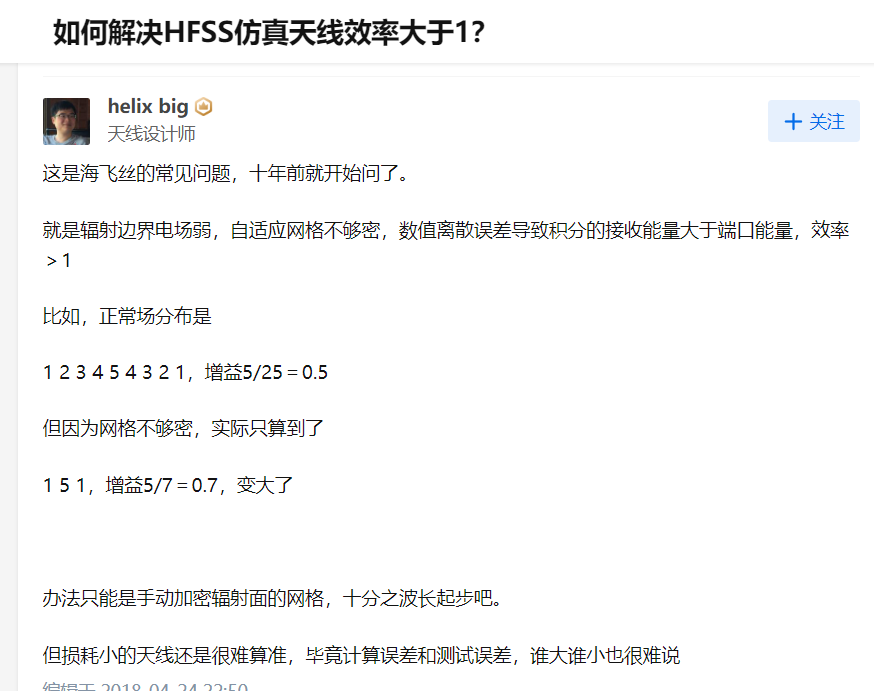

【HFSS】仿真时radiation efficiency(辐射效率)大于1

在自编码器中使用深度网络已成为有前途的研究方向,这种学习网络有两个挑战: 处理量化与控制reconstruction error (distortion) entropy (rate) of the latent image representation之间的权衡(rate都用熵表 ......

compress压缩模块功能测试

功能介绍 产生随机测试文本或者进行功能验证 功能验证指通过分别通过verilog与python打印压缩后序列,进行文本比对。 python代码 import sys import random import argparse str_line = '' def huffmancode(RG_type ......

通过时序和上下文对比学习时间序列表征《Time-Series Representation Learning via Temporal and Contextual Contrasting》(时间序列、时序表征、时态和上下文对比、对比学习、自监督学习、半监督学习)

现在是2023年11月14日的22:15,肝不动了,要不先回寝室吧,明天把这篇看了,然后把文档写了。OK,明天的To Do List. 现在是2023年11月15日的10:35,继续。 论文:Time-Series Representation Learning via Temporal and C ......

ALSA Compress-Offload API

概述 从 ALSA API 的早期开始,它就被定义为支持 PCM,或考虑到了 IEC61937 等固定比特率的载荷。参数和返回值以帧计算是常态,这使得扩展已有的 API 以支持压缩数据流充满挑战。 最近这些年,音频数字信号处理器 (DSP) 常常被集成进片上系统 (SoC) 设计中,且 DSPs 也 ......

TALLRec: An Effective and Efficient Tuning Framework to Align Large Language Model with Recommendation

目录概TallRec代码 Bao K., Zhang J., Zhang Y., Wang W., Feng F. and He X. TALLRec: An effective and efficient tuning framework to align large language model ......

AT_agc034_e Complete Compress

原题链接 这里是用 set 实现的换根 DP,时间复杂度 \(O(n\log n)\)。 记 \(siz_x,g_x,f_x\) 分别为 \(x\) 及其子树中有多少个关键点,所有关键点到 \(x\) 的距离和,将关键点尽可能两两向上合并后到 \(x\) 的距离和(我愿意理解为是将 \(g_x\) ......

2023CVPR_Efficient Frequency Domain-based Transformers for High-Quality Image Deblurring

一. Motivation 1. Transformer在解决全局表现很好,但是复杂度很高,主要体现在QK的乘积: (We note that the scaled dot-product attention computation is actually to estimate the corre ......

Checkerboard Context Model for Efficient Learned Image Compression

目录AbstractIntroductionPreliminary 初步介绍Variational Image Compression with Hyperprior(超先验变分图像压缩)Autoregressive Context(自回归上下文模型)Parallel Context Modelin ......

ELIC: Efficient Learned Image Compression with Unevenly Grouped Space-Channel Contextual Adaptive Coding

abstruct \(\quad\) 受能量压缩表现的启发,提出了不均匀通道情况自适应编码.结合不均匀分组模型和现有上下文模型,获得一种空间通道上下文自适应模型,来提高编码性能,而不影响其运行时间。 \(\quad\)这种模型支持预览解码和渐进解码。 introduction 学习图像压缩中最重要的 ......

【CVPR2023】Efficient and Explicit Modelling of Image Hierarchies for Image Restoration

> 论文:https://readpaper.com/paper/4728855966703960065 代码:https://github.com/ofsoundof/GRL-Image-Restoration 这个论文的代码地址叫GRL,意思是 Global, Regional, Local 的 ......

2023ACMMM_Mutual Information-driven Triple Interaction Network for Efficient Image Dehazing

一. Motivation 之前网络存在的缺点: 1. 使用的有限的频域信息 2. 不充足的信息交互 : (1) 第一阶段的输出直接作为第二阶段的输入,忽略了中间特征从早期到后期的传播 (2) 在编码器解码器结构同尺度之间进行特征融合,忽略了阶段内和跨阶段的跨尺度信息交换 3. 严重的特征冗余:中间 ......

gzip: stdin: invalid compressed data--format violated

当执行解压命令,出现 tar: Error is not recoverable: exiting now 。 tar -zxvf xxx.tar.gz 错误详情如下: 原因:下载的文件并不是通过 gzip过滤归档,去掉-z参数即可,执行: tar -xvf xxx.tar.gz ......

Conditional Probability Models for Deep Image Compression

深度神经网络被训练来作为图像压缩的自动编码器是一个前沿方向,面临的挑战有两方面——量化(quantization)和权衡reconstruction error (distortion) and entropy (rate),这篇文章关注后者。 主要思想是使用上下文模型直接对潜在表示的熵建模;3D- ......

Conditional Probability Models for Deep Image Compression

深度神经网络被训练来作为图像压缩的自动编码器是一个前沿方向,面临的挑战有两方面——量化(quantization)和权衡reconstruction error (distortion) and entropy (rate),这篇文章关注后者。 主要思想是使用上下文模型直接对潜在表示的熵建模;3D- ......

论文阅读:A Lightweight Knowledge Graph Embedding Framework for Efficient Inference and Storage

ABSTRACT 现存的KGE方法无法适用于大规模的图(由于存储和推理效率的限制) 作者提出了一种LightKG框架: 自动的推断出码本codebooks和码字codewords,为每个实体生成合适的embedding。 同时,框架中包含残差模块来实现码本的多样性,并且包含连续函数来近似的实现码字的 ......