embedding knowledge graph gnn

Is Homophily a Necessity for Graph Neural Networks?

目录概 Ma Y., Liu X., Shah N. and Tang J. Is homophily a necessity for graph neural networks? ICLR, 2022. 概 探究 Homophily 假设 (即相互连接的结点相似) 对于 GCN 发挥效果是否是必须 ......

神经网络基础篇:史上最详细_详解计算图(Computation Graph)

计算图 可以说,一个神经网络的计算,都是按照前向或反向传播过程组织的。首先计算出一个新的网络的输出(前向过程),紧接着进行一个反向传输操作。后者用来计算出对应的梯度或导数。计算图解释了为什么用这种方式组织这些计算过程。在这个博客中,将举一个例子说明计算图是什么。让举一个比逻辑回归更加简单的,或者说不 ......

nn.Embedding torch.nn.Embedding

nn.Embedding torch.nn.Embedding 随机初始化词向量矩阵:这种方式很容易理解,就是使用self.embedding = torch.nn.Embedding(vocab_size, embed_dim)命令直接随机生成个初始化的词向量矩阵,此时的向量值符合正态分布N(0, ......

GraphPrompt: Unifying Pre-Training and Downstream Tasks for Graph Neural Networks

目录概符号说明GraphPrompt代码 Liu Z., Yu X., Fang Y. and Zhang X. GraphPrompt: Unifying pre-training and downstream tasks for graph neural networks. WWW, 2023. ......

GPT-GNN: Generative Pre-Training of Graph Neural Networks

目录概符号说明GPT-GNN代码 Hu Z., Dong Y., Wang K., Chang K. and Sun Y. GPT-GNN: Generative pre-training of graph neural networks. KDD, 2020. 概 比较早的一篇图预训练模型. 符号 ......

[论文速览] SimCSE@ Simple Contrastive Learning of Sentence Embeddings

Pre title: SimCSE: Simple Contrastive Learning of Sentence Embeddings accepted: EMNLP 2021 paper: https://arxiv.org/abs/2104.08821 code: https://githu ......

UniKGQA Unified Retrieval and Reasoning for Solving Multi-hop Question Answering Over Knowledge Graph

目录概主要内容代码 Jiang J., Zhou K., Zhao W. and Wen J. UniKGQA: Unified retrieval and reasoning for solving multi-hop question answering over knowledge graph ......

Open Domain Question Answering Using Early Fusion of Knowledge Bases and Text

目录概主要内容代码 Sun H., Dhingra B., Zaheer M., Mazaitis K., Salakhutdinov R. and Cohen W. W. Open domain question answering using early fusion of knowledge ......

论文阅读:Unifying Large Language Model and Knowledge Graph:A RoadMap

1 Introduction 大模型和知识图谱结合的综述。 简单介绍一下大模型和知识图谱的优缺点: 如上所示。 本文主要划分为三个模块,分别为: KG-enhanced LLMs LLM-augmented KGs Synergized LLM + KG 2 Background 主要介绍了LLM和 ......

GRLSTM:基于图的残差LSTM轨迹相似性计算《GRLSTM: Trajectory Similarity Computation with Graph-Based Residual LSTM》(知识图谱嵌入、图神经网络、残差网络、点融合图、多头图注意力网络GAT、残差LSTM、点感知损失函数(图的点损失函数、轨迹的点损失函数))

2023年10月18日,14:14。 来不及了,这一篇还是看的翻译。 论文:GRLSTM: Trajectory Similarity Computation with Graph-Based Residual LSTM(需要工具才能访问) Github: AAAI 2023的论文。 摘要 轨迹相似 ......

Sampling from Large Graphs

目录概主要内容 Leskovec J. and Faloutsos C. Sampling from large graphs. KDD, 2006. 概 讨论了不同稀疏化方法对于 large-graph 的`结构' 的保持. 主要内容 作者本文的目的是希望比较不同的'稀疏化'方法: 利用一些方法从 ......

论文阅读:Knowledge Distillation via the Target-aware Transformer

摘要 Knowledge distillation becomes a de facto standard to improve the performance of small neural networks. 知识蒸馏成为提高小型神经网络性能的事实上的标准。 Most of the previo ......

Robust Graph Representation Learning via Neural Sparsification

目录概符号说明NeuralSparse Zheng C., Zong B., Cheng W., Song D., Ni J., Yu W., Chen H. and Wang W. Robust graph representation learning via neural sparsifica ......

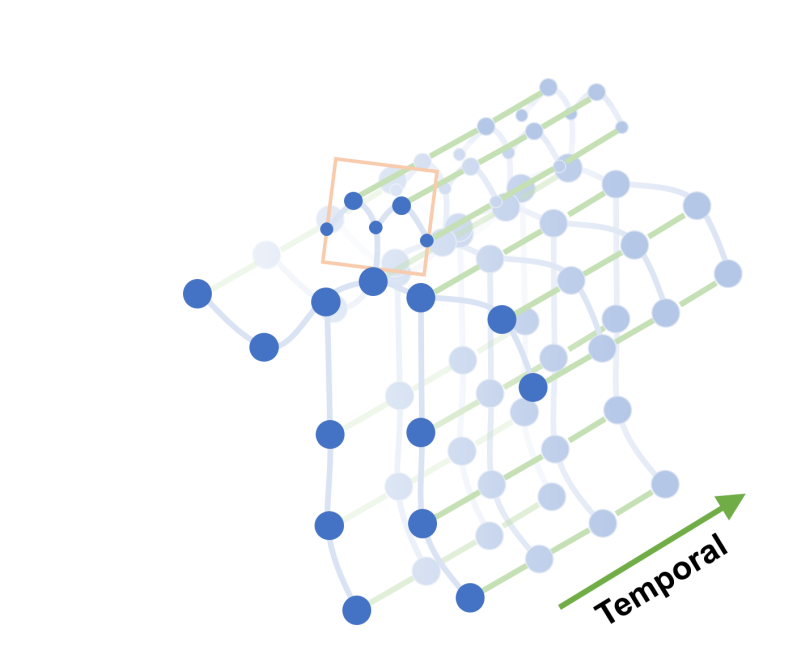

学习笔记:Graph WaveNet

学习和复现一下经典模型Graph WaveNet,事实证明结果跟现在的比也差不了多少,速度也挺快。目前就先把经典模型都学习一遍吧。 ......

pytorch(9.7) keras-Embedding 嵌入层

https://www.tensorflow.org/text/guide/word_embeddings 将文本表示为数字 机器学习模型将向量(数字数组)作为输入。处理文本时,您必须做的第一件事是想出一种策略,将字符串转换为数字(或“矢量化”文本),然后再将其输入模型。 1独热编码 作为第一个想法 ......

论文阅读(四)—— Spatial Temporal Graph Convolutional Networks for Skeleton-Based Action Recognition

——Channel-wise Topology Refinement Graph Convolution for Skeleton-Based Action Recognition

代码 实验 python main.py --config config/nturgbd-cross-subject/default.yaml --work-dir work_dir/ntu/csub/ctrgcn --device 0 --num-worker 0 综述 ......

ABC262E - Red and Blue Graph

原题 翻译 诈骗诈骗诈骗诈骗诈骗诈骗诈骗诈骗!!! 第一眼看上去很像一个 NP-Hard 问题,完全没有思路 然后以为 dp ,然后看数据范围一眼寄 首先遇到 01 染色问题,而且一边连接的两点颜色相同/不同(其实主要是不同)会产生贡献的问题,要考虑一下能不能先统一染成一个颜色,然后看改变颜色后会产 ......

Graph Wave Net模型中的数据集hdf5和pkl文件的读取问题

引入:GraphWaveNet的流量数据的文件格式是.h5,路网结构文件格式是.pkl,它们怎么打开呢? HDF5 HDF5文件一般以 .h5 或者 .hdf5 作为后缀名,其中包含两种结构:Group(文件夹)和Datasets(数据) python可以使用 h5py 或 pandas 打开.h5 ......

Triangle Graph Interest Network for Click-through Rate Prediction

目录概TGINMotivation: Triangle 的重要性Model代码 Jiang W., Jiao Y., Wang Q., Liang C., Guo L., Zhang Y., Sun Z., Xiong Y. and Zhu Y. Triangle graph interest ne ......

Dual Graph enhanced Embedding Neural Network for CTR Prediction

目录概DG-ENN Guo W., Su R., Tan R., Guo H., Zhang Y., Liu Z., Tang R. and He X. Dual graph enhanced embedding neural network for ctr prediction. KDD, 202 ......

【Unity3D】Shader Graph简介

1 Shader Graph 简介 Shader Graph 是 Unity 官方在 2018 年推出的 Shader 制作插件,是图形化的 Shader 制作工具,类似于 Blender 中的 Shader Editor 和 UE 中的 Material Editor,它使用流程图的形式表达顶 ......

Trying to backward through the graph a second time

原因是把创建loss的语句loss_aux = torch.tensor(0.)放在循环体外了,可能的解释是第一次backward后把计算图删除,第二次backward就会找不到父节点,也就无法反向传播。参考:https://stackoverflow.com/questions/55268726/ ......

Fi-GNN: Modeling Feature Interactions via Graph Neural Networks for CTR Prediction

目录概Fi-GNN代码 Li Z., Cui Z., Wu S., Zhang X. and Wang L. Fi-GNN: Modeling feature interactions via graph neural networks for ctr prediction. CIKM, 2019. ......

JavaScript Library – YouTube Embedded、YouTube Player API、YouTube Data API

YouTube Embed Video 参考: Embed videos & playlists 它和 Google Maps Embed 类似,是通过 iframe 完成的。 <iframe width="800" style="aspect-ratio: 16 / 9" src="https:/ ......

Graph Laplacian for Semi-Supervised Learning

目录概符号说明Graph-Laplacian for SSL Streicher O. and Gilboa G. Graph laplacian for semi-supervised learning. arXiv preprint arXiv:2301.04956, 2023. 概 标题取得有 ......

Graph RAG: 知识图谱结合 LLM 的检索增强

RAG(Retrieval Argumented Generation)这种基于特定任务/问题的文档检索范式中,我们通常先收集必要的上下文,然后利用具有认知能力的机器学习模型进行上下文学习(in-context learning),来合成任务的答案。这次,我们借助 LLM 的力量,强化下 RAG。 ......

Go - Finding the Shortest Path on a Graph

Problem: You want to find the shortest path between two nodes on a weighted graph. Solution: Use Dijkstra’s algorithm to find the shortest path betwee ......

AttributeError: module 'tensorflow' has no attribute 'get_default_graph'

具体操作命令是:创建一个python <3.8的虚拟环境。conda create -n your_env_name python=3.6激活并进入该环境。activate your_env_name安装1.x版本的tensorflow。pip install tensorflow==1.15.0 ......

AttributeError: module 'tensorflow' has no attribute 'reset_default_graph'

环境配置: python3.7 tensorflow2.0 Window 10初始代码:tf.reset_default_graph()解决方法:import tensorflow as tftf.compat.v1.reset_default_graph()或者是这样:import tensorf ......